一、常用优化器对比

1. 随机梯度下降(SGD)

- 原理:每次迭代使用小批量数据计算梯度并更新参数。

- 优点:实现简单,适合大规模数据集。

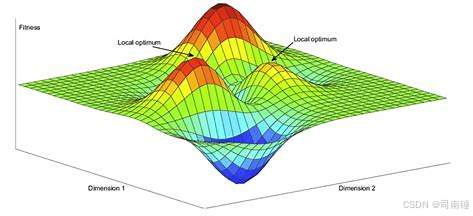

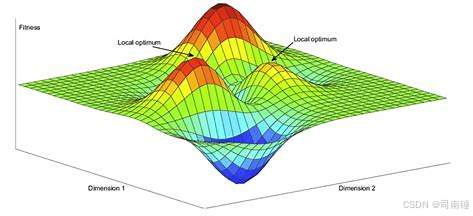

- 缺点:收敛速度慢,容易陷入局部最优或鞍点。

- 适用场景:简单凸优化问题或需要精细调参的任务。

2. 带动量的SGD(SGDM)

- 原理:引入动量项,累积历史梯度以加速收敛并减少震荡。

- 优点:收敛更快,训练更稳定。

- 缺点:需调整动量超参数(通常设为0.9)。

- 适用场景:计算机视觉(CV)任务,如CNN训练。

3. Adagrad

- 原理:自适应调整学习率,累加历史梯度平方。

- 优点:适合稀疏数据(如NLP任务)。

- 缺点:学习率单调衰减,可能导致训练后期停滞。

- 适用场景:稀疏数据或特征重要性差异较大的任务。

4. RMSProp

- 原理:改进Adagrad,使用梯度平方的指数移动平均。

- 优点:缓解学习率过快衰减问题。

- 缺点:对初始学习率敏感。

- 适用场景:非平稳目标问题,如RNN训练。

5. Adam

- 原理:结合动量(一阶矩)和RMSProp(二阶矩),自适应调整学习率。

- 优点:收敛快,适合大多数任务。

- 缺点:可能泛化性能稍差,对初始学习率敏感。

- 适用场景:NLP、强化学习、GAN等复杂任务。

6. AdamW

- 原理:解耦权重衰减与梯度更新,改进Adam。

- 优点:提升泛化能力,适合Transformer架构。

- 适用场景:大规模预训练模型(如BERT)。

二、常用学习率调度器对比

1. 指数衰减(Exponential Decay)

- 原理:学习率按指数函数衰减。

- 优点:平滑减小学习率,适合稳定收敛。

- 适用场景:训练过程较长,需平缓调整学习率的任务。

2. 步长衰减(Step Decay)

- 原理:每隔固定步长按比例降低学习率。

- 优点:简单直观,适合分阶段训练。

- 适用场景:明确分阶段的训练任务(如先粗调后微调)。

3. 余弦退火(Cosine Annealing)

- 原理:学习率按余弦函数周期性变化。

- 优点:避免局部最优,适合复杂模型。

- 适用场景:深层神经网络或需要周期性调整的任务。

4. 多项式衰减与预热(Polynomial Decay with Warm-up)

- 原理:训练初期逐步增加学习率(预热),后期多项式衰减。

- 优点:防止初期震荡,适合大模型(如BERT)。

- 适用场景:Transformer等复杂模型训练。

5. 动态调整(ReduceLROnPlateau)

- 原理:监控验证集损失,性能未提升时降低学习率。

- 优点:自适应调整,避免浪费计算资源。

- 适用场景:验证集性能波动较大的任务。

三、优化器与调度器的搭配建议

- SGD/SGDM + 步长衰减:适合CV任务,如ResNet训练。

- Adam + 余弦退火:适合NLP或复杂模型,如Transformer。

- AdamW + 预热调度:适合大规模预训练模型。