AI打开潘多拉魔盒?当深度伪造成为虚假信息的核动力引擎

引言:虚假信息——数字时代的“隐形武器”

在人工智能(AI)与社交媒体深度融合的今天,虚假信息(Disinformation)已成为全球社会面临的最严峻挑战之一。

source: Gartner.(2024). 2025 Top Strategic Technology Trends.

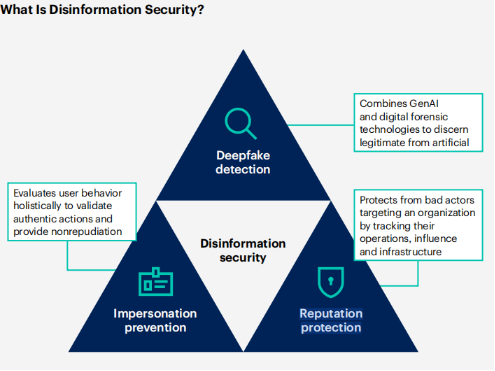

从操纵选举到扰乱金融市场,从煽动社会动荡到实施跨国诈骗,虚假信息及其衍生技术(如深度伪造 Deepfake)正在重塑信息战的形态。2024年,世界银行将虚假信息列为全球十大风险之一,预计到2028年,50%的企业将被迫部署专门技术应对此类威胁[9]。

本文将探讨虚假信息的演变、技术挑战及全球应对策略,以揭示这场“数字真相保卫战”的全景。

source: Sensity AI. (2024). The State Of Deepfakes 2024.

一、虚假信息的威胁升级:从谣言到深度伪造武器化

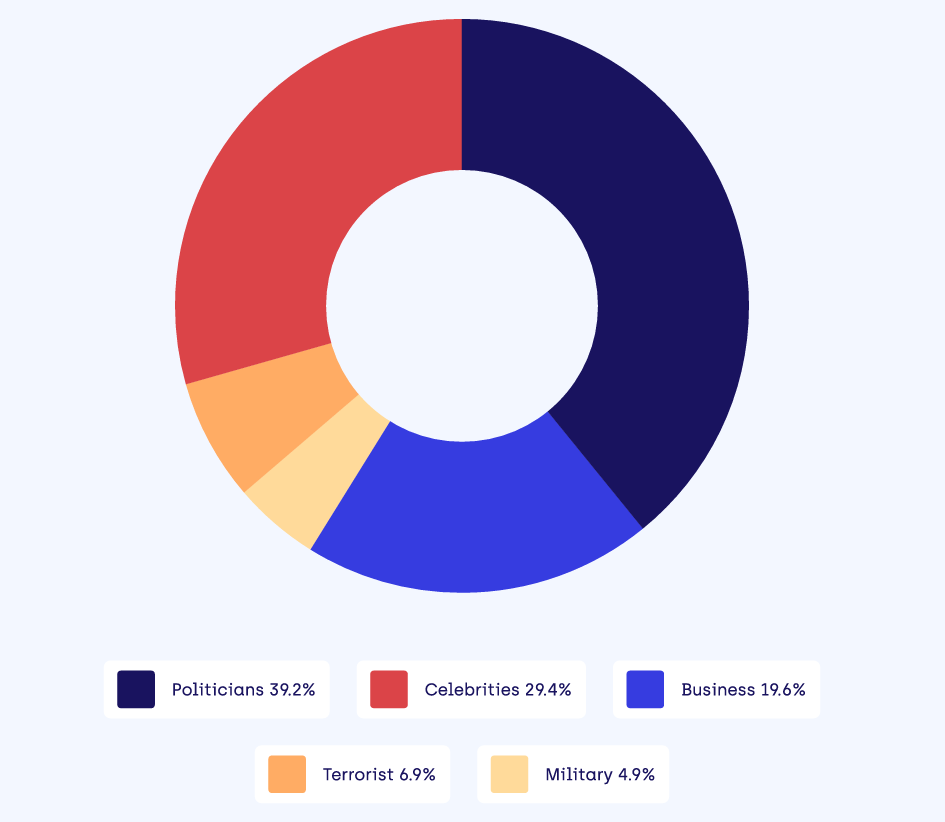

虚假信息已从简单的文本谣言演变为多模态、高仿真的系统性攻击工具。根据NightDragon的报告,2023年全球因虚假信息导致的股市损失高达780亿美元,而深度伪造(Deepfake)市场在2019-2020年间暴增900%[1]。2024年,90%的网络内容可能由AI生成,66%的企业遭遇过深度伪造攻击[1][5]。

典型案例分析:

-

地缘政治操纵:俄罗斯、伊朗等国通过伪造“气象武器”指控抹黑美国[1];以色列和哈马斯双方在媒体对抗中,使用人工智能工具来创造有利于己方的叙事[5]。

source: Sensity AI. (2024). The State Of Deepfakes 2024.

-

金融欺诈:英国某企业员工因深度伪造视频会议被骗转账2500万美元[1];澳大利亚2024年因虚假信息导致的诈骗损失仍达20.3亿澳元[4];利用语言克隆等技术伪造名人背书引诱投资。

-

社会撕裂:美国2024年大选期间,深度伪造的候选人言论视频引发信任危机,迫使科技公司紧急升级检测工具[5][8]。

source: 今日头条.(2024).https://www.toutiao.com/article/7432562062649311795/

-

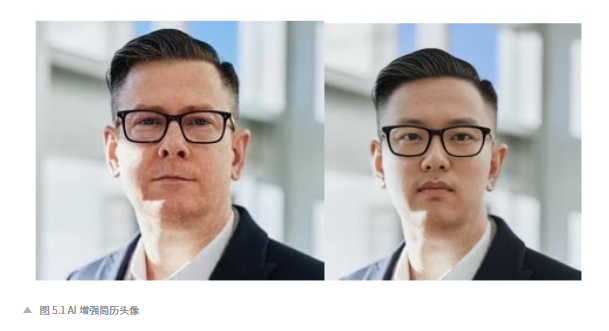

网络威胁:2024 年 7 月 23 日,安全厂商 KnowBe4 的博客中披露,一攻击者通过 AI 增强生成图片伪造有效但被盗的身份照片,制造假简历成功入职目标公司后,以员工身份在内网发起攻击[10]。

source: 奇安信威胁情报中心. (2025). 网络安全威胁2024年度报告.

二、技术挑战:深度伪造与检测的“猫鼠游戏”

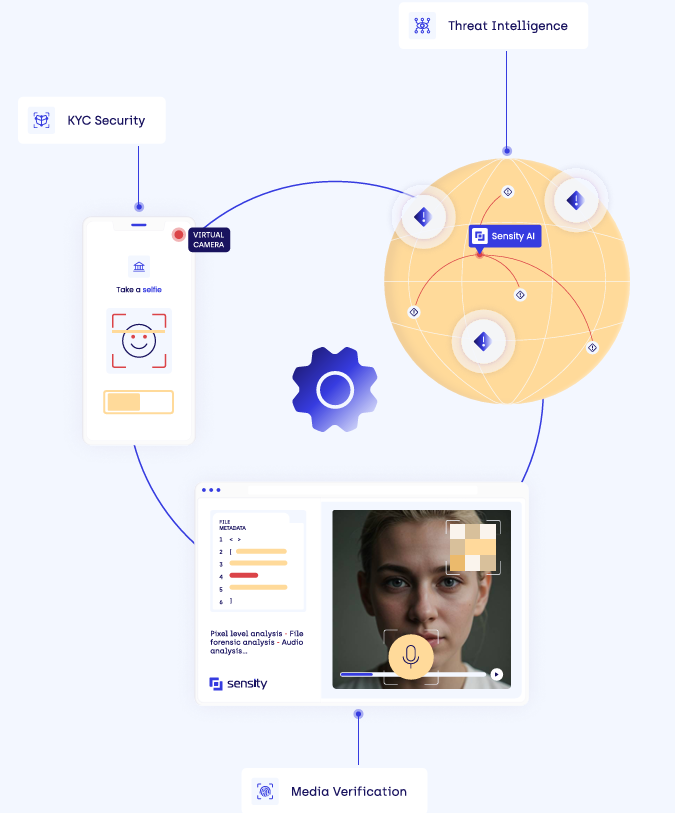

深度伪造技术的平民化使其威胁指数级上升。Sensity AI数据显示,2024年已有2298款面部替换工具和47款专门用于绕过身份验证(KYC)的软件流通于暗网[5]。学术研究表明,当前检测模型在真实场景中表现堪忧:开源模型在Deepfake-Eval-2024基准测试中,视频检测AUC下降50%,音频下降48%[8]。

技术瓶颈:

-

泛化能力不足:多数检测模型依赖过时数据集(如FaceForensics++),难以应对最新生成技术(如Stable Diffusion)[6][8]。

-

多模态攻击:虚假信息常结合文本、图像、音频,利用跨模态一致性漏洞绕过检测[8]。

-

对抗性样本:攻击者通过添加噪声或微调模型参数,使伪造内容规避检测[6]。

三、全球应对:构建“防御-治理-韧性”三位一体体系

1. 技术创新:从被动检测到主动防御

-

多模态检测框架:如Inclusion 2024竞赛中,冠军团队提出基于聚类与对抗训练的通用检测模型,在未知伪造类型中表现提升30%[6]。

-

区块链与溯源技术:欧盟通过《数字服务法》(DSA)要求平台对AI生成内容添加数字水印[2][7]。

source: Sensity AI. (2024). The State Of Deepfakes 2024.

2. 政策治理:立法与跨国协作

-

欧盟:建立“快速预警系统”(Rapid Alert System),强制平台删除虚假信息,并对违规企业处年营业额6%的罚款[2][7]。

-

美国:FTC拟修订《反冒名顶替规则》,要求AI工具开发者承担“合理知悉”责任,遏制技术滥用[3]。

-

中国:2024年《网络安全法》修订,强化对APT组织供应链攻击的打击,并推动国产检测工具研发[10]。

3. 社会韧性:媒体素养与公众参与

-

教育行动:芬兰将“媒体素养”纳入中小学必修课,荷兰设立国家媒体素养网络[7]。

-

公众参与:澳大利亚“停止-思考-标记”(Stop-Check-Protect)运动提升民众辨识能力,爱尔兰“媒体智慧”计划覆盖85%成年人口[4][7]。

四、未来展望:AI的双刃剑与伦理边界

Gartner预测,2028年AI将成为虚假信息攻防的核心工具[9]。然而,技术本身无善恶,关键在于治理框架:

-

伦理规范:OECD呼吁建立“信息完整性”全球标准,要求AI开发嵌入透明度与问责机制[7]。

-

跨国协作:需仿照《国际信息与民主宣言》,构建技术共享与情报联动平台[7][10]。

未来防御需突破单一技术维度,构建“技术-法律-公众”协同的韧性体系。只有通过跨学科研究、跨国合作与持续教育,才能在AI浪潮中守护信息空间的真实性,避免“数字迷雾”吞噬社会信任。

参考文献

[1] NightDragon. (2024). Market Report: Disinformation.

[2] 欧盟委员会. (2024). 《应对虚假信息和信息操纵情况说明书》.

[3] TechNet. (2024). Comments on FTC Impersonation Rule.

[4] 澳大利亚竞争与消费者委员会. (2025). Targeting Scams Report 2024.

[5] Sensity AI. (2024). The State Of Deepfakes 2024.

[6] Zhang, Y. et al. (2024). Inclusion 2024: Global Multimedia Deepfake Detection.

[7] OECD. (2024). Facts not Fakes: Tackling Disinformation, Strengthening Information Integrity.

[8] Chandra, N. A. et al. (2024). Deepfake-Eval-2024: A Multimodal In-the-Wild Benchmark.

[9] Gartner.(2024). 2025 Top Strategic Technology Trends.

[10] 奇安信威胁情报中心. (2025). 网络安全威胁2024年度报告.