【漫话机器学习系列】223. T 统计量(t-statistics)

【统计基础】深入理解 T 统计量(t-statistics)——公式、意义与应用详解

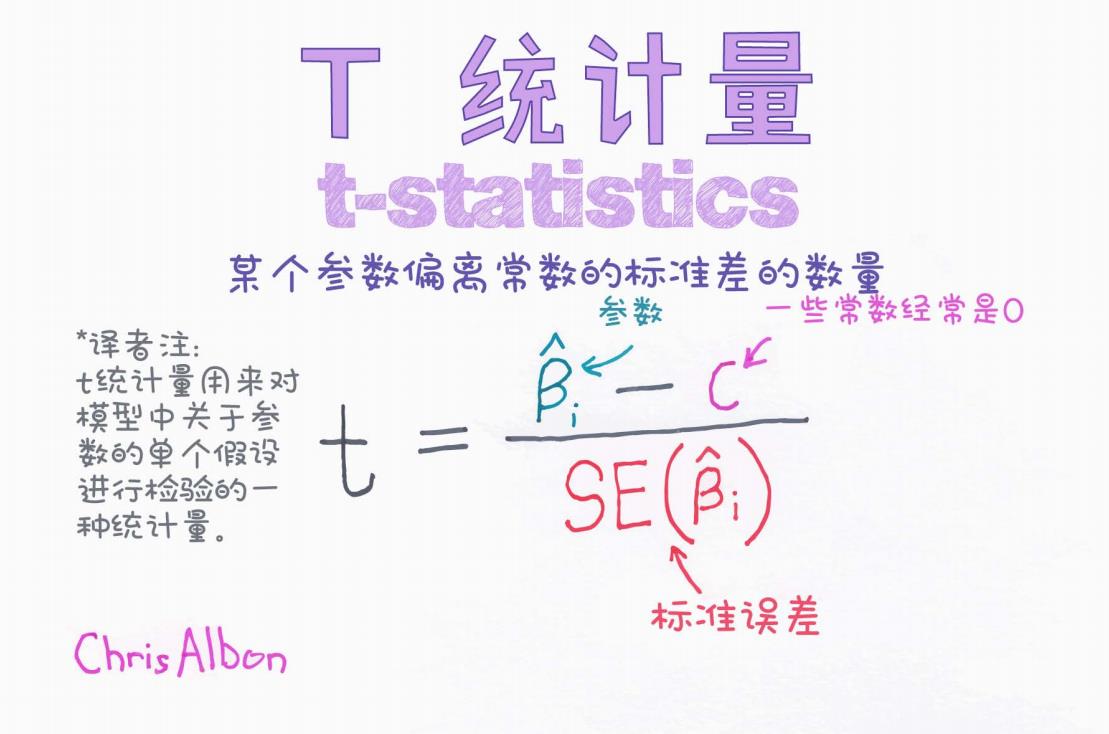

在统计学与机器学习的建模过程中,我们常常会遇到一个非常关键的统计量——T 统计量(t-statistics)。它是进行假设检验的基础之一,尤其在检验某个参数是否显著时扮演着核心角色。

本文将围绕以下几个问题来深入剖析 T 统计量:

-

T 统计量是什么?

-

它的公式怎么理解?

-

具体该如何使用?

-

图示中各个部分的意义?

本文配图来自 Chris Albon 手绘知识卡,结合直观的视觉讲解,希望你能更轻松理解这一核心概念。

一、什么是 T 统计量?

T 统计量是用来对一个参数是否与某个理论值(通常是 0)显著不同进行检验的一种统计量。简而言之,它衡量的是“我们估计出来的参数和理论值之间的偏离,是否足够大到可以认为这个参数是显著的”。

举个例子:

假设我们在线性回归模型中想检验某个系数是否为 0,即:

H₀:β = 0(无效假设)

H₁:β ≠ 0(备择假设)

我们就可以使用 T 统计量来做判断。

二、T 统计量的公式详解

我们来看一下 T 统计量的核心公式(如下图所示):

图中各个部分解释如下:

:估计的参数

:估计的参数

这是我们通过模型拟合得到的某个回归系数,比如线性回归中某个变量对应的权重。

C:对比值

这是理论上的常数值,通常为 0,表示我们希望检验该参数是否等于 0。

:标准误差

:标准误差

表示估计值 的不确定程度。标准误差越大,t 值越小,参数越不显著。

t 值的意义:

t 值越大(绝对值),代表参数与理论值之间的差异越大,从而越可能拒绝原假设(H₀),认为该参数具有统计显著性。

三、图示详细解释

图源:Chris Albon,手绘清晰直观地展示了 T 统计量的结构。

从图中我们可以看到:

-

上面是估计值与理论值的差异(偏离程度)

-

下面是标准误差(估计值的不确定性)

整个比值的本质是:

该参数的“偏离程度”在其自身不确定性范围内的倍数。

四、T 统计量的实际应用场景

在数据分析与机器学习模型中,T 统计量被广泛应用,尤其在以下场景中:

1. 回归模型系数显著性检验

用于判断线性回归、多元回归模型中,哪些变量是真正“有用”的。

2. 单样本 t 检验

检验一个样本的均值是否与某个理论值显著不同。

3. 双样本 t 检验

判断两个组是否具有相同的均值(如 A/B 测试中两组用户的转化率对比)。

五、如何判断显著性?

一般我们会结合 t 值所对应的 p 值(概率值) 来判断是否显著:

-

如果 p 值 < 0.05,通常认为结果是显著的,可以拒绝原假设;

-

如果 p 值 > 0.05,表示没有足够证据拒绝原假设。

p 值越小,t 值的绝对值越大,表示参数越显著。

六、总结

| 项目 | 含义 |

|---|---|

| t 统计量 | 衡量参数与理论值之间的标准化偏差 |

| β | 模型中的参数 |

| C | 假设检验中的理论值,通常为 0 |

| SE | 标准误差,估计值的波动性 |

| 应用 | 参数显著性检验、均值检验等 |

七、参考资料

-

Chris Albon’s Machine Learning Flashcards

-

《统计学习方法》

-

Coursera - Regression Models (Johns Hopkins)

如果你觉得这篇文章对你有帮助,欢迎点赞收藏,或者关注我一起学习更多统计知识!