Tmi-clnet:从影像学、临床和放射学数据融合判断慢性肝病预后的三模态相互作用网络——医学图像论文学习,论文源码下载

论文地址:https://arxiv.org/pdf/2502.00695v1

源码地址:https://github.com/Mysterwll/liver

一、主要内容

本文提出了名为TMI-CLNet的三模态交互网络,用于慢性肝病的预后评估。具体来说,开发了一个模态内聚合模块和一个三模态交叉注意融合模块,分别用于消除模态内冗余和提取跨模态信息。此外,我们设计了一个三模态特征融合损失函数来对齐跨模态的特征表示。实验结果表明,该方法在肝病预后数据集上的表现显著优于现有的单模态和多模态技术。

二、提出背景

由病毒感染引起的慢性肝炎 乙型肝炎病毒(HBV)和丙型肝炎病毒的感染 (HCV)可发展为肝硬化和肝细胞癌 肝细胞癌(HCC);因此,为临床医生提供及时的、准确的预后结果指导早期干预和治疗决策对于减轻慢性肝病的健康负担至关重要。在临床实践中,患者提供各种非影像学数据,包括人口统计信息、全血细胞计数报告和脂质分析报告,以及常规影像学检查,如计算机断层扫描(CT)。同时,放射组学可以从医学影像数据中提取定量特征来描述疾病特征。通过综合领域知识和辅助信息的整合,可以建立一个全面、精确的慢性肝病预后模型,从而为临床实践提供鲁棒的支持。

许多研究已经探索了不同领域的多模态方法,通常通过简单的连接或注意机制合并不同的模态。然而,这些传统的方法不能准确地捕捉不同模态之间的复杂关系,并且在处理大量数据类型时遇到困难,因此无法满足更复杂数据集的需求。

三、解决的问题

1、怎么做的

为了应对这些挑战,本研究开创性地引入了一种多模式的方法来评估慢性肝病的预后。本研究的工作有三个显著贡献:(1)据文章所知,这是将CT成像、放射学特征和临床信息同时整合到一个统一的多模式学习框架中的开创性研究。(2)设计了一个独特的TCAF模块,以解决不同模式之间的异质性。该模块有效地提取跨模态信息,生成全面的全局特征表示。(3)在训练过程中,引入TMFF损失来对齐这三种模式之间的特征表示,以确保一致的语义匹配。

2、具体模型讲解

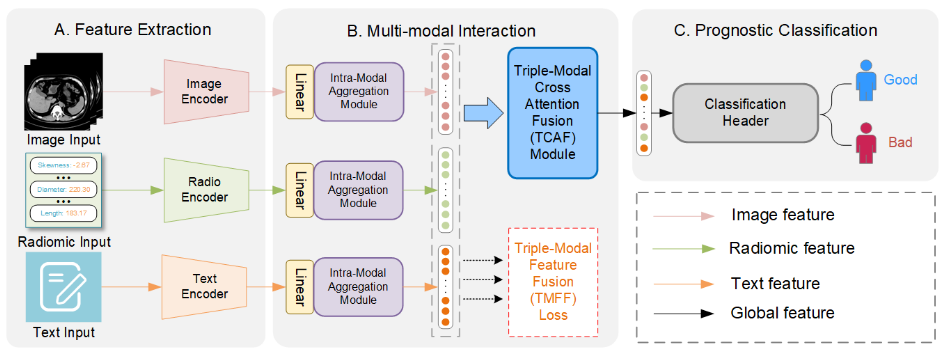

图1 :本文提出的TMI-CLNet概述。给定CT扫描,放射学特征和临床文本,接着将它们输入到独立的模态编码器中以提取高维特征。随后,通过多模态相互作用将这些特征融合为整体特征,用于预后分类。同时,利用TMFF损失对多模态特征进行对齐。

在特征提取模块中,采用预训练的3D ResNet-50作为视觉编码器,提取深度视觉特征。利用多层感知器(Multilayer Perceptron, MLP)作为放射组学编码器,对放射组学数据进行张紧处理,得到更抽象的特征表示。对于临床文本,使用预训练的BioBERT模型作为文本编码器,选择最后一个隐藏层的输出作为文本特征表示。在分类头模块中,使用预训练的1D DenseNet-121作为分类头。

(1)特征提取模块:

a、ResNet-50

Resnet50 是一个经典的图像分类网络,并且在图像分类任务上表现出色,总共50个卷积算法,它的创新就是引入了残差块,这种结构通过跳跃连接解决了深度网络中的梯度消失和退化问题,从而可以确保网络深度可以搭建的很深。

b、多层感知机(MLP)

放射组学(Radiomics)是从医学影像(如CT、MRI)中提取大量定量特征(如纹理、形状、强度等)的技术。直接使用原始放射组学特征可能存在冗余、噪声或维度灾难问题。通过MLP编码器对数据进行张紧处理,实现降维(提取低维判别性特征)、抽象化(捕捉高阶病理关联)和去噪(过滤冗余信息),从而增强特征的鉴别能力和模型的鲁棒性。

c、BioBERT模型

BioBert首先使用BERT的基础模型进行预训练,然后在PubMed数据库的大量生物医学论文上进行微调。这使得模型能够理解和捕获生物医学领域的专业词汇和语义。与通用的BERT相比,BioBERT更深入地理解了生物医学术语,这是因为它的训练数据源包含了丰富的专业知识。如同BERT,BioBert也使用Transformer架构,允许模型考虑词语的前后上下文,以生成更加精确的表示。

(2)多模态交互模块

在这个模块中,本文从一开始就使用线性层将特征提取模块获得的高维特征映射到统一的尺寸。然后,通过模内聚合(IMA)模块对标准化的高维特征进行处理,以提高其质量。IMA的核心是一个包含16个注意头的多头自注意力机制机制。IMA的主要作用是在特征融合前对模态内信息进行整合,从而提高融合过程的有效性,增强模型的整体性能。

a、三模态交叉注意融合模块

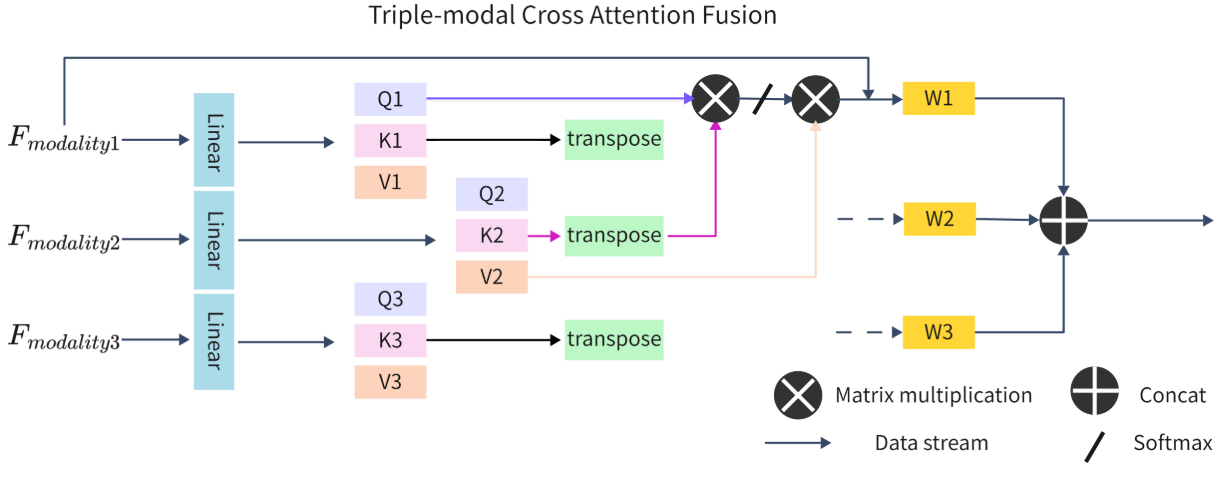

图 2 概述本研究提出的TCAF模块。将来自模态1的独立特征的突出过程整合在一起,产生跨模态特征。

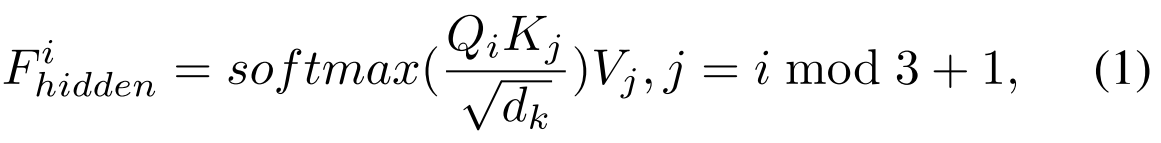

该模块的结构如图2所示。经过IMA模块处理后,来自不同模态的增强特征通过线性层分别计算其查询(Q)、键(K)和值(V)分量以进行注意力运算。每一模态的Q会与相邻模态的K的转置相乘,随后通过softmax层归一化,再与相邻模态的V相乘,从而得到当前模态的注意力权重。其数学表达式可表述为:

其中和

表示模态的索引,

是向量K的维数,而且,一个模

表示

除以

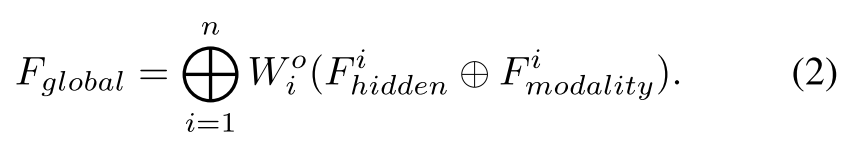

的余数。这是因为第三模态通过计算运算与第一模态相互作用。随后,为了保留原有的独立特征信息,将注意力得分(

)与初始特征(

)进行拼接。然后将这个组合输出乘以一个可学习的权重矩阵(

)。该程序始终适用于来自三种不同模式的输入。最后,将结果连接起来产生全局特征输出(

)。数学上,这可以表示为:

这确保了连接的特征有效地作为全面的全局特征表示。

b、损失函数

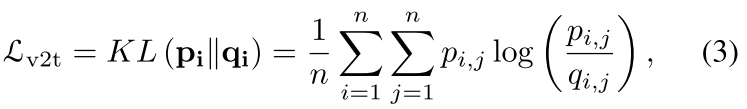

TMFF损失。为了将不同模式的特征对齐,本文从相似分布匹配(SDM)损失[7]中获得灵感,并开发了专门针对临床文本、放射组学和深度图像特征的TMFF损失。SDM损失最初是为视觉和文本嵌入的全局对齐而设计的,其定义为:

其中q表示真实匹配概率,p表示特定余弦相似度分数相对于总和的分数。双向SDM损耗累加了v2t和t2v损耗。因此,视觉和文本模式之间的SDM损失可以描述为:

![]()

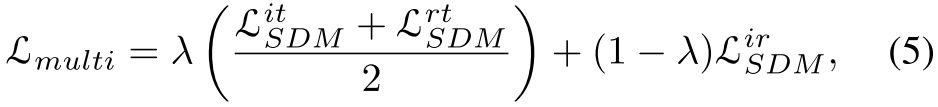

为了调整三种模式的特征,本文计算了它们的成对SDM损失:(图像和文本),

(放射组学和文本)和

(图像和放射组学)。考虑到不同模态对之间SDM损失的不对称性以及图像和放射组学特征之间的相似性,将图像与文本对齐应该对应于将放射组学与文本对齐。因此,我们将TMFF损耗定义为:

其中λ∈[0,1]是控制对齐项相对重要性的标量权重系数。

总体损失函数。我们采用联合损失函数来优化整个TMI-CLNet网络。整体损失函数被表示为特定任务和多模态对齐损失的加权和。数学上,这可以表示为:

![]()

其中是常用的交叉熵损失函数,α是一个加权超参数,用来平衡

和

的贡献。α的值由实验确定,典型值设为1。

(3)分类头模块(DenseNet-121)

DenseNet作为分类头的优势主要体现在其独特的密集连接机制:通过将每一层的特征图与所有后续层直接连接,实现多尺度特征的深度融合与高效复用,既能增强梯度传播、缓解深层网络的训练难题,又能显著减少参数量,在提升模型精度的同时保持轻量化。此外,密集连接隐含的特征多样性增强了分类头的判别能力,尤其适用于医学影像等需精细特征表达的复杂任务。

3、解决了什么问题(有什么优点)

(1)解决多模态数据融合中的异质性问题

(2)克服单一模态信息不足的局限性

(3)减少模态内冗余噪声干扰

(4)改进现有多模态方法的适应性缺陷

(5)解决特征空间不对齐问题

四、总结与展望

本研究提出了TMI-CLNet,该网络整合了CT影像学、放射学特征和临床信息,为慢性肝病患者提供早期预后评估。通过引入TCAF模块和TMFF损失函数,该模型可以解决不同模态之间的异质性,从而取得了显著的性能。实验结果证明了该方法的有效性。在未来,可以将重点扩展数据集,进行多中心验证,提高计算效率,以增强模型的鲁棒性和可扩展性。此外,本研究的方法提供了一个有价值的视角,可以扩展到其他疾病或模式,使其适合未来在不同领域的各种应用。