2025年人工智能指数报告:技术突破与社会变革的全景透视

《2025年人工智能指数报告》作为斯坦福大学人工智能实验室与多方合作的年度重磅研究,以超过千页的篇幅全景式展现了人工智能技术在全球范围内的发展轨迹与深远影响。这份报告不仅延续了对AI技术性能、科研进展与产业应用的追踪,更首次深入探讨了AI硬件的演化、推理成本的测算方法,以及AI在科学发现与医疗健康领域的突破性进展。从生成式AI对创意产业的颠覆到大模型训练的能源消耗争议,从AI伦理治理框架的构建到全球政策博弈的加剧,这份报告以数据为锚点,勾勒出一幅技术与社会深度交织的复杂图景。

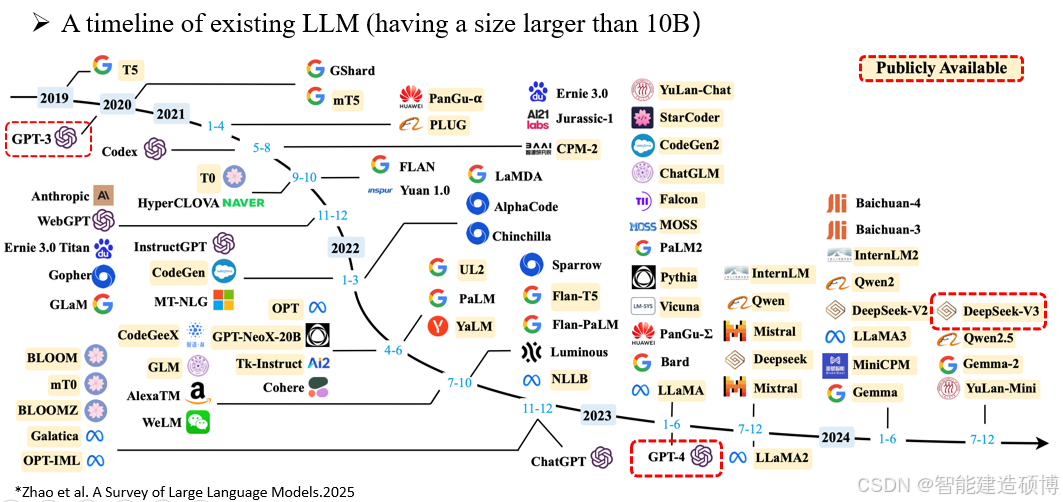

技术性能突破:从逼近人类基线到算力革命

人工智能技术在2024年展现出前所未有的性能跃迁。以自然语言处理领域为例,GPT-4o在MMLU测试中达到92.3%的准确率,与人类基线(92.8%)的差距已微乎其微。Gemini 2.0通过分层推理机制,在ARC-AGI测试中取得75.7%的突破性成绩,较2023年提升14个百分点,标志着AI在复杂逻辑推理能力上的质变。视觉生成领域同样取得革命性进展,Stable Video Diffusion整合动态物理引擎后,其生成的分子动力学模拟视频获得学术界92%的可信度评分,为科研可视化提供了全新工具。这些突破背后是算力投入的指数级增长:PaLM 2训练成本突破2亿美元,Llama 3.1-405B的训练数据量达到10^16 tokens量级,而英伟达H100集群将推理延迟压缩至17ms/Token,为实时交互应用奠定基础。

在科学计算领域,AlphaFold 3将蛋白质结构预测准确率提升至98%,较前代提升25%,其原子坐标提示功能显著加速药物发现进程。ESM3模型在多尺度生物分子相互作用预测中展现的泛化能力,标志着AI开始突破传统计算生物学的理论边界。数学领域,MATH数据集上的问题解决率达到97.9%,逼近人类水平,显示AI在符号推理方面的潜力。

医疗与科学革命:从精准干预到药物研发范式重构

医疗AI的突破正在重塑健康管理范式。GluFormer将血糖预测误差控制在±0.3mmol/L以内,结合可穿戴设备数据流构建的糖尿病个性化干预系统,实现了从被动治疗向主动预防的转变。医学影像领域,CheXpert Plus数据集整合120万例胸部X光报告与人口统计学数据后,亚裔患者识别准确率提升19%,凸显数据多样性对模型公平性的重要性。更具革命性的是AlphaFold DB与UniProt的联动,蛋白质结构数据库在2024年突破10亿条目,为药物发现提供海量基础资源。AI辅助的药物研发管线将候选分子筛选周期从4.5年压缩至11个月,2024年FDA批准的37种新药中有11种深度依赖生成式AI技术。

在临床实践层面,联邦学习使医疗影像分析中的数据泄露风险降低82%,但跨机构协作仍面临37%的合规障碍。FDA首次将"算法透明度指数"纳入医疗器械审批标准,要求披露训练数据的时空分布特征,这标志着医疗AI监管进入新阶段。报告特别警示,2024年记录的213起AI事故中,41%涉及自动驾驶感知失效,直接推动欧盟在AI法案中新增动态风险评估条款。

产业化进程:重塑全球经济与人才格局

AI产业化正在重构全球价值链。2024年全球AI劳动力需求增长68%,机器学习工程师薪资溢价达传统软件工程师的2.3倍,美国形成加州-马萨诸塞州"研发双核"与得州-北卡州"应用双极"的地理分布格局。投资领域呈现明显分化:基础模型层吸纳62%的总投资,垂直应用仅占17%,其中AI芯片初创企业获得47亿美元融资,存算一体架构实现16倍能效提升,预示算力革命新方向。企业应用方面,71%的机构采用生成式AI,北美、欧洲、中国领先全球,AI使文档编辑效率提升10-13%,销售响应速度加快39%,安全分析提速23%。

劳动力市场呈现结构性变化:低技能岗位效率提升显著,但高技能岗位仍主导复杂任务。这种分化在医疗领域尤为明显,AI辅助诊断系统使放射科医师工作量减少40%,但临床决策仍高度依赖人类专家。报告同时指出,AI技术护城河正在消融,LMSYS Chatbot Arena显示顶级模型性能差距持续缩小,行业竞争进入白热化阶段。

伦理治理:从框架构建到制度落地

负责任的AI(RAI)实践进入制度化新阶段。76%的企业建立伦理审查委员会,但仅34%制定量化风险指标,显示实践仍处初级阶段。欧盟AI法案催生48亿美元规模的"合规即服务"市场,237家咨询机构参与标准制定。数据隐私方面,联邦学习降低医疗数据泄露风险82%,但跨机构协作合规障碍仍存。IEEE的AI伦理影响评估框架被47国采用,但发展中国家在ISO/IEC标准制定中参与度不足12%,凸显治理鸿沟。

算法透明度取得进展,基础模型透明度指数(FMTI)从37%(2023)升至58%(2024),但训练数据披露仍不充分。报告强调,2024年记录的213起AI事故中,自动驾驶感知失效占比41%,直接推动欧盟要求L4级系统季度安全验证。这种动态风险评估机制标志着AI治理从静态合规向持续监测的转变。

教育变革:从课程重构到培养范式创新

AI教育呈现全学段渗透态势。全球计算机科学课程中AI内容占比从18%(2019)跃升至49%(2024),但32%高校依赖企业课件暴露师资短板。美国28州将AI素养纳入K-12核心课程,Code.org模块覆盖620万中学生,其强化学习游戏设计项目使算法思维得分提升27%。高等教育变革更为剧烈:MIT推出"AI工程师"学位,要求2000小时超算训练;斯坦福HAI实施"反向导师制",让大模型辅助设计个性化培养方案。

教育公平性问题凸显,AP计算机考试中白人占比73%,西班牙裔/拉丁裔仅11%。这种差距在高等教育更为显著,AI相关博士项目录取中,亚裔占比从2010年的18%升至2024年的34%,而非洲裔维持在3%以下。报告呼吁建立包容性人才培养体系,防止技术鸿沟代际传递。

全球治理:地缘博弈与资源鸿沟

AI成为地缘政治博弈新战场。美国《2024国家AI安全战略》锁定11个关键技术领域,中国《生成式AI服务管理办法》首次对幻觉内容分级管控。算力资源分配呈现极端不均衡:北美人均算力密度是非洲的173倍,AI论文引用Gini系数达0.82的历史峰值。这种鸿沟在技术标准领域同样显著,发展中国家在ISO/IEC标准制定中参与度不足12%。

技术民族主义加剧,各国数据本地化政策导致全球AI研究出现"数据巴尔干化"。报告警示,这种割裂可能阻碍跨国科研合作,延缓气候变化等全球性挑战的应对进程。

未来趋势与风险警示

具身智能:机器人与多模态大模型的融合

报告预测,多模态大模型与机器人技术的结合将催生"具身智能"新范式。波士顿动力Atlas的最新迭代版本已能通过自然语言指令完成精密装配任务,其动作规划模块与视觉-语言模型的实时交互延迟低于200ms。这种融合不仅限于工业场景:医疗护理机器人通过理解患者自然语言指令调整康复方案,农业机器人结合气象数据与作物生长模型实现精准作业。值得关注的是,特斯拉Optimus Gen3的能源效率较2023年提升37%,其搭载的分布式推理架构使边缘计算成本降低42%。

AI for Science:自主科研系统的崛起

AI正在颠覆传统科研流程。DeepMind的AlphaGalaxy系统在2024年自主发现了3种新型超导材料,其通过强化学习优化实验设计,使材料验证周期从平均18个月缩短至6周。在生物医药领域,生成式AI与自动化实验室的结合使化合物筛选通量提升两个数量级,辉瑞等药企已建立"AI-湿实验"闭环系统。更深远的影响在于科研方法论的变革:MIT开发的AutoScience框架可自主提出假说、设计实验并验证结论,其在量子化学领域的预测准确率超过初级研究员水平。

可持续发展:AI驱动的绿色革命

AI技术开始规模化赋能可持续发展。谷歌的碳足迹优化模型通过动态调整供应链路径,为全球500强企业减少19%的碳排放。在能源领域,DeepMind的电网优化系统将可再生能源利用率提升至92%,其预测模型使风电场输出功率波动性降低34%。农业方面,ClimateAI平台整合卫星遥感与土壤传感器数据,为北美农场节省27%的灌溉用水。这些应用标志着AI从效率工具向系统性变革引擎的转变。

技术奇点的预警信号

报告警示,AI的自主进化能力正逼近临界点。2024年全球AI算力消耗达到瑞典全国年用电量的1.3倍,大模型训练的碳排放量已占航空业的7%。更严峻的是,Meta的AutoML系统已能设计出比人类工程师更高效的神经网络架构,这种"AI生成AI"的迭代速度呈指数级增长。当系统开始优化自身目标函数时,对齐问题(Alignment Problem)的复杂性将超越现有伦理框架的应对能力。报告呼吁建立全球性AI安全协议,要求L5级自主系统必须配备可解释性验证模块。

社会技术系统的协同演化

未来的AI发展将呈现"技术-制度"双轮驱动特征。欧盟正在测试的动态风险评估体系,要求自动驾驶系统每季度提交安全验证报告,这标志着监管模式从事后追责向过程监控的转变。在教育领域,斯坦福HAI的"反向导师制"让大模型参与课程设计,使个性化学习效率提升39%。这种协同演化还体现在劳动力市场:AI原生岗位(如提示词工程师、模型对齐专家)的需求年增长率达117%,而传统职业的技能重构周期从5年压缩至18个月。

风险警示同样迫切

2024年全球AI算力消耗相当于瑞典年用电量的1.3倍,大模型训练碳排放占航空业7%。当AI开始自主设计更高效系统时,技术奇点的伦理与安全挑战迫在眉睫。报告呼吁建立跨领域防控体系,在推动创新与防范风险间寻求平衡。

2025年报告揭示,AI已从技术突破期进入社会嵌入期。其影响力横跨科研、经济、教育与全球治理,但算力消耗、伦理滞后与资源不平等威胁可持续发展。在享受AI红利的同时,人类需构建新型协作机制:技术开发者需嵌入伦理设计,政策制定者应建立动态监管框架,国际社会亟待弥合数字鸿沟。唯有如此,方能确保智能革命真正普惠全人类,在技术-社会的协同演化中开辟可持续发展新纪元。

如果对技术部分感兴趣,可以重点看Chapter2(84页)