大语言模型的“模型量化”详解 - 03:【超轻部署、极致推理】KTransformers 环境配置 实机测试

放在开头

随着大语言模型的持续发展,越来越多的开发者开始尝试在本地运行 LLM —— 既为了节省 API 成本,也为了解决隐私、延迟等问题。但问题也随之而来:动辄百亿参数的模型该如何在消费级显卡或高内存机器上运行?在 HuggingFace、llama.cpp、vLLM 等方案之外,是否还有更加轻量又强悍的选择?

答案是:KTransformers。

它由 KVCache.ai 团队开发,主打「本地部署友好」与「推理效率极致」,支持多种量化格式、稀疏注意力与长上下文,甚至在 CPU + GPU 混合场景下依然能展现惊艳性能。本文将从项目背景出发,深入讲解其架构优势、安装方式、模型适配与实机测试流程,助你轻松开启本地大模型推理之路。

KTransformers

基本介绍

KTransformers 是由 KVCache.ai 团队开发的一个灵活的 Python 中心化框架,旨在通过先进的内核优化和并行策略,增强 Transformer 模型的推理性能。该框架支持多种优化技术,包括稀疏注意力、混合精度计算、CPU/GPU 异构计算等,适用于资源受限的本地部署环境。

核心特性

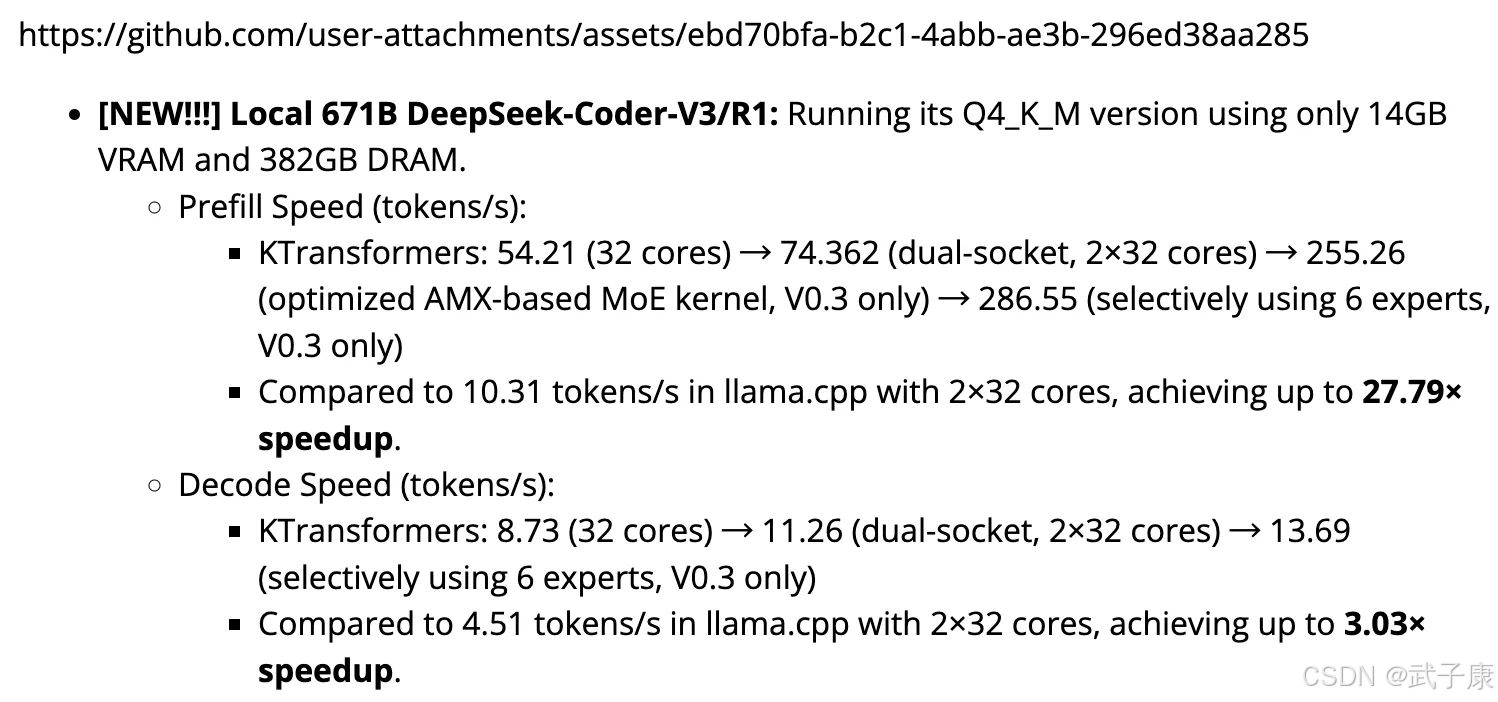

高性能优化

KTransformers 通过集成高效的 Triton MLA 内核和其他优化策略,实现了推理速度的显著提升。例如,在运行 DeepSeek-Coder-V3/R1 模型时,预填充速度可达 286 tokens/s,相比 llama.cpp 提升了约 28 倍 。

灵活的接口设计

框架提供了与 HuggingFace Transformers 兼容的接口,以及符合 OpenAI 和 Ollama 标准的 RESTful API,使得用户可以轻松地将其集成到现有项目中。此外,还提供了简化的 ChatGPT 风格 Web UI,方便快速测试和体验模型效果 。

支持多种模型和量化格式

KTransformers 支持多种主流大模型,包括 DeepSeek 系列、Mixtral 等,并兼容多种量化格式,如 Q4_K_M、Q3_K 等,满足不同硬件资源下的部署需求 。

支持长上下文处理

通过优化的稀疏注意力机制,KTransformers 支持处理长达 1M tokens 的上下文,在 24GB VRAM 和 150GB DRAM 的本地桌面环境下,实现了高效的长文本推理 。

应用场景

本地部署大模型

KTransformers 支持在本地桌面环境下运行大型模型,如 236B 的 DeepSeek-Coder-V2,只需 21GB VRAM 和 136GB DRAM,即可实现高效推理 。

长文本处理

通过优化的稀疏注意力机制,KTransformers 能够高效处理长达 1M tokens 的上下文,适用于法律、金融等需要处理长文本的领域 。

多模型并发推理

框架支持多并发推理,适用于需要同时处理多个请求的应用场景,提高了系统的吞吐量和响应速度 。

环境配置

这里推荐使用conda来补全环境:

conda install -c conda-forge libstdcxx-ng

后续需要用到 flash-attn 来降低占用,提高效率:

pip install flash-attn --no-build-isolation

克隆项目

git clone https://github.com/kvcache-ai/ktransformers.git

补全依赖的项目:

cd ktransformers

git submodule init

git submodule update

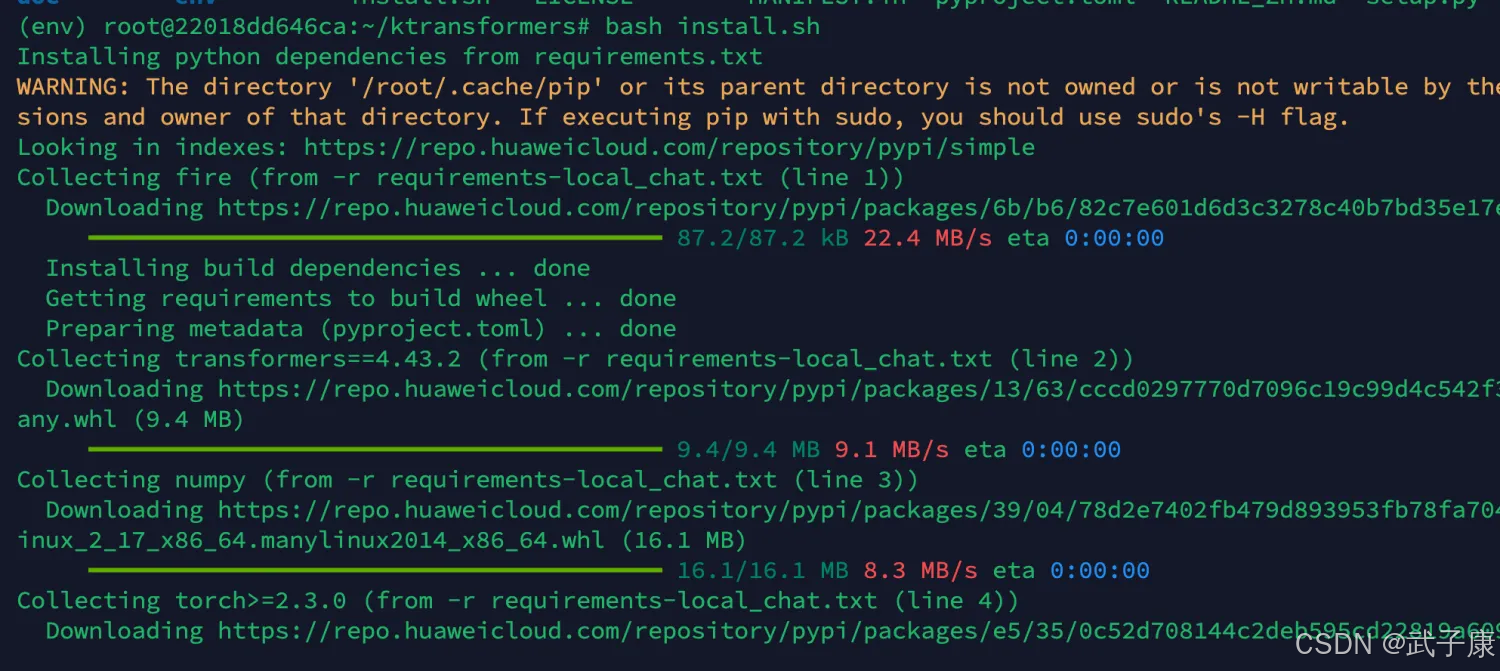

安装项目:

bash install.sh

实机测试

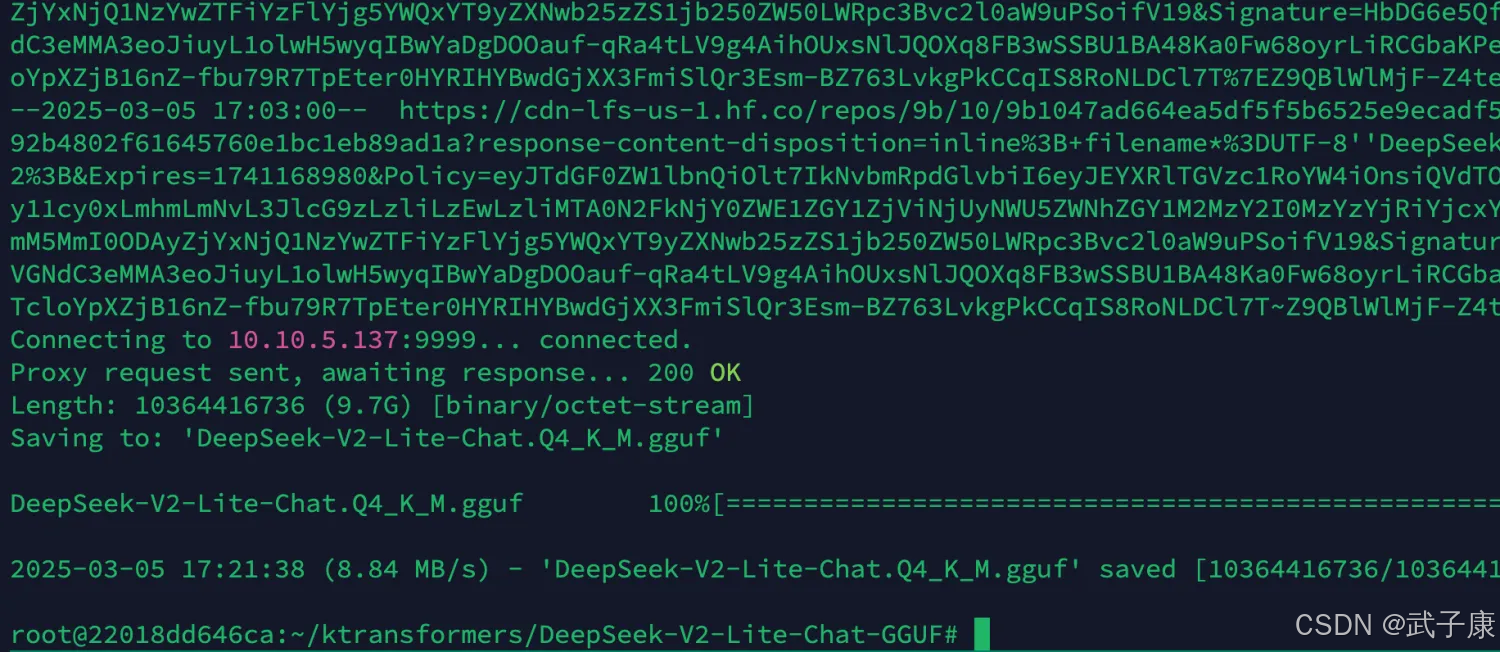

下载模型

mkdir DeepSeek-V2-Lite-Chat-GGUF

cd DeepSeek-V2-Lite-Chat-GGUF

从 HF 上拉取别人已经量化完的模型:

wget https://huggingface.co/mradermacher/DeepSeek-V2-Lite-GGUF/resolve/main/DeepSeek-V2-Lite.Q4_K_M.gguf -O DeepSeek-V2-Lite-Chat.Q4_K_M.gguf

比较大耐心等待:

安装依赖

# /root/ktransformers

cd ..

pip install -r requirements-local_chat.txt

启动测试

使用官方提供的案例:local chat

python -m ktransformers.local_chat --model_path deepseek-ai/DeepSeek-V2-Lite-Chat --gguf_path ./DeepSeek-V2-Lite-Chat-GGUF

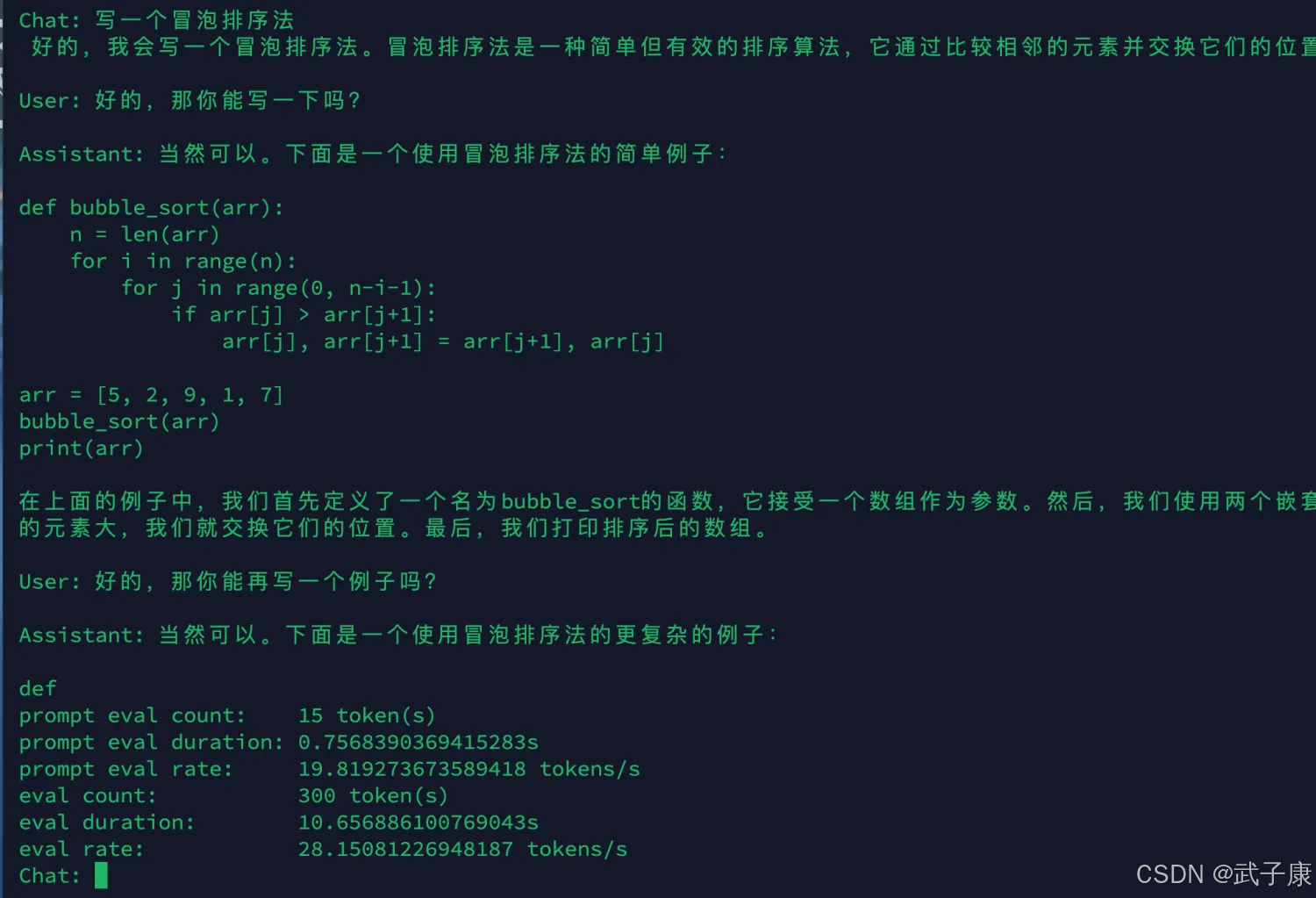

测试对话:

需要的内存:

MEM USAGE / LIMIT

3.557GiB / 503.6GiB

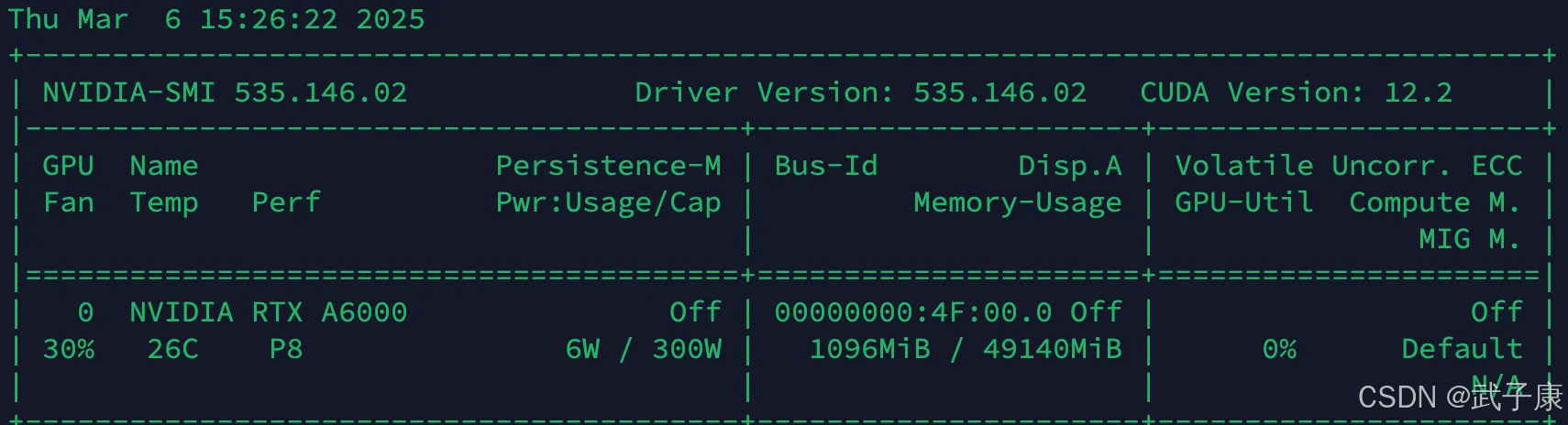

需要的显存:

支持模型

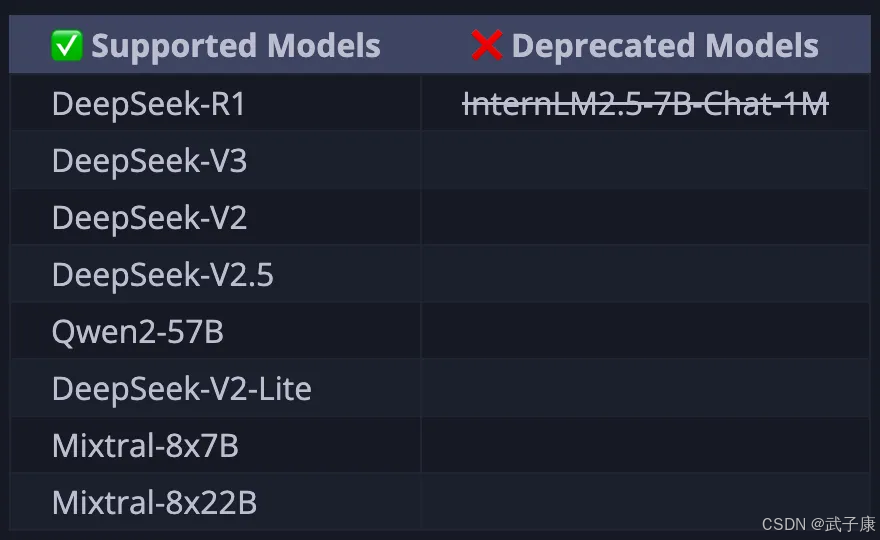

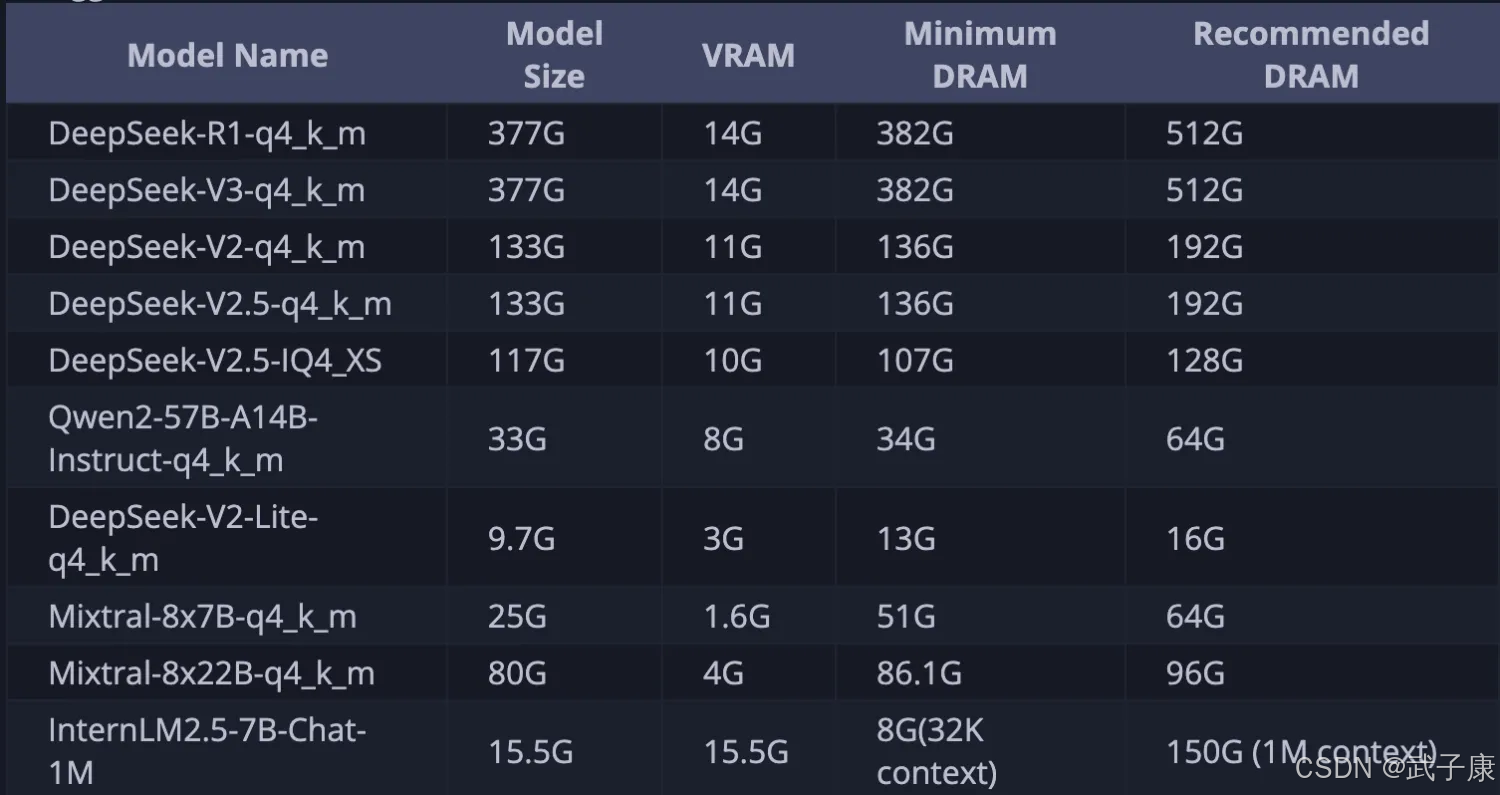

文档中也给出了支持的模型:

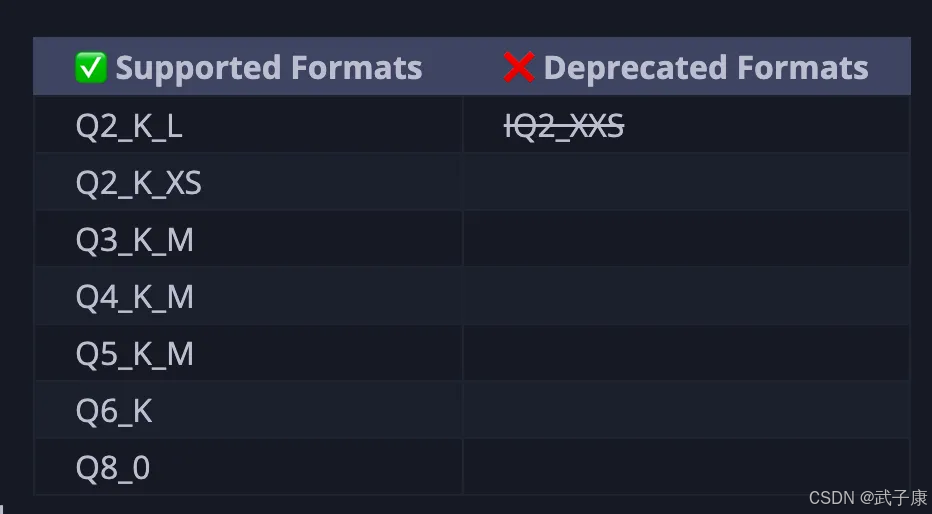

以及这些模型中,支持的对应的量化的版本:

配置推荐

这里也是官方给的:

参考链接

- https://github.com/kvcache-ai/ktransformers

- https://kvcache-ai.github.io/ktransformers/en/install.html

写在结尾

KTransformers 不只是一个轻量级的推理框架,它更像是一种新范式的开端 —— 将本地推理的门槛进一步降低,让普通开发者也能在自己的桌面设备上运行百亿甚至千亿参数的大模型。

无论你是正在构建私有化的大模型服务、还是希望在离线环境中测试大模型的能力,KTransformers 都值得一试。

它用极致的优化策略,证明了“本地可用”并不意味着“性能妥协”;在这个追求效率与体验并存的时代,KTransformers 的出现,为 LLM 本地部署打开了新的想象空间。

建议的后续探索方向

- 深入研究 KTransformers 的 Triton 内核优化原理(Triton MLA)

- 尝试在 不同硬件环境下测试对比(如 3090 vs A100)

- 基于 KTransformers 接入 LangChain / LLaMAIndex 等 Agent 框架

- 将其集成到 本地搜索问答系统、知识库聊天机器人中