windows上的RagFlow+ollama知识库本地部署

一、 docker的安装与部署

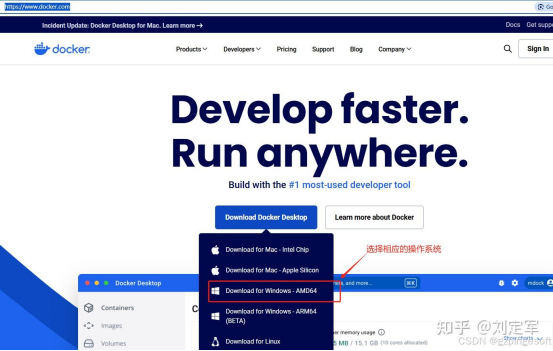

1. 下载Docker Desktop

访问Docker官网并下载适用于Windows的Docker Desktop安装程序。

RagFlow对docker的要求: Docker ≥ 24.0.0 & Docker Compose ≥ v2.26.

docker 下载地址:

https://www.docker.com/

Get Docker | Docker Docs

如下图所示:

2. 安装Docker

如下图 双点击 Docker Desktop Installer.exe 进行安装,安装完成后可以重启电脑也可以不重启电脑。

![]()

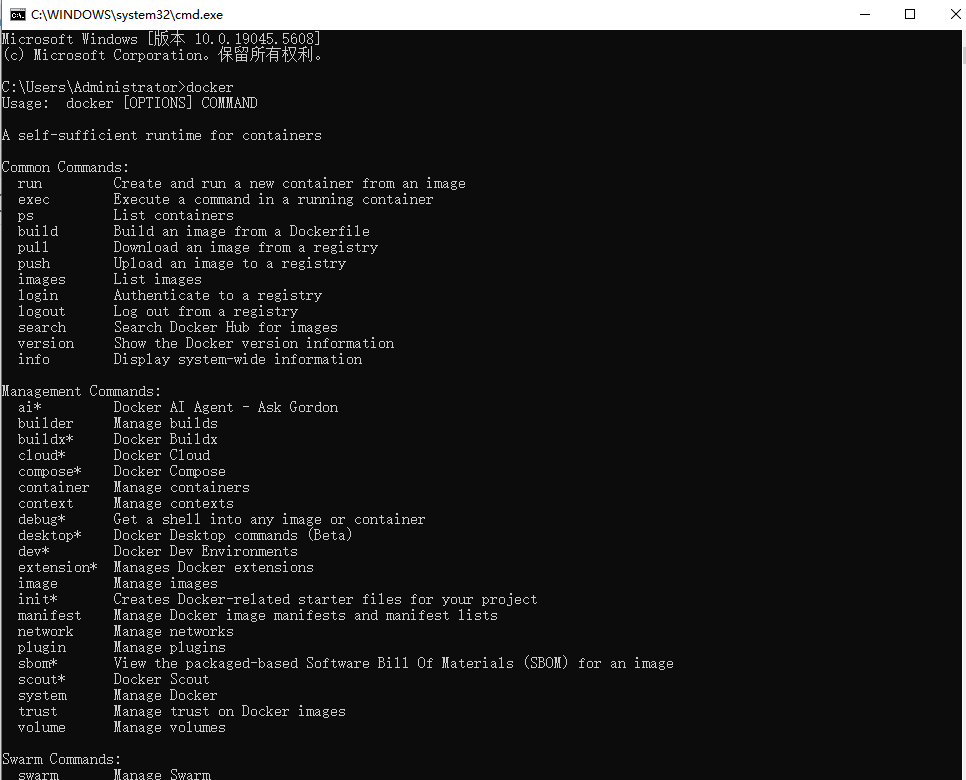

3. 检查Docker 安装是否成功

按windos键+r 打开终端控制台 输入docker,按回车,如有如下输出信息则表示docker安装成功。

4. 错误处理

安装完docker,如果Docker Engine无法正常启动,多半是WSL 等环境没有配置好。

4.1 WSL安装

手动下载wsl

下载地址: https://wslstorestorage.blob.core.windows.net/wslblob/wsl_update_x64.msi

下载完安装后,重启docker尝试是否正常,如果仍不正常,参考下述文档说明查找问题。

安装WSL文件 档: 安装 WSL | Microsoft Learn

手动安装 WSL 的步骤

如果您需要手动安装 WSL(例如在旧版本 Windows 上),可以参考以下文档:

- 手动安装 WSL 的完整步骤

旧版 WSL 的手动安装步骤 | Microsoft Learn

- 该文档适合无法使用 wsl --install 命令的情况。

- 包括启用 WSL 功能、安装 Linux 内核更新包、设置默认版本(WSL 1 或 WSL 2)等

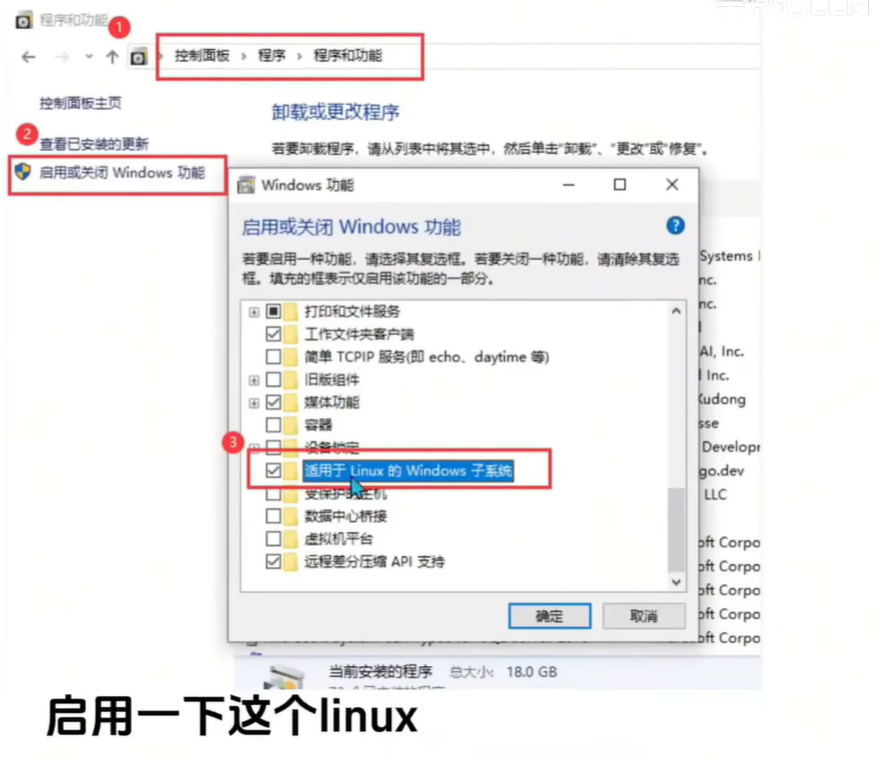

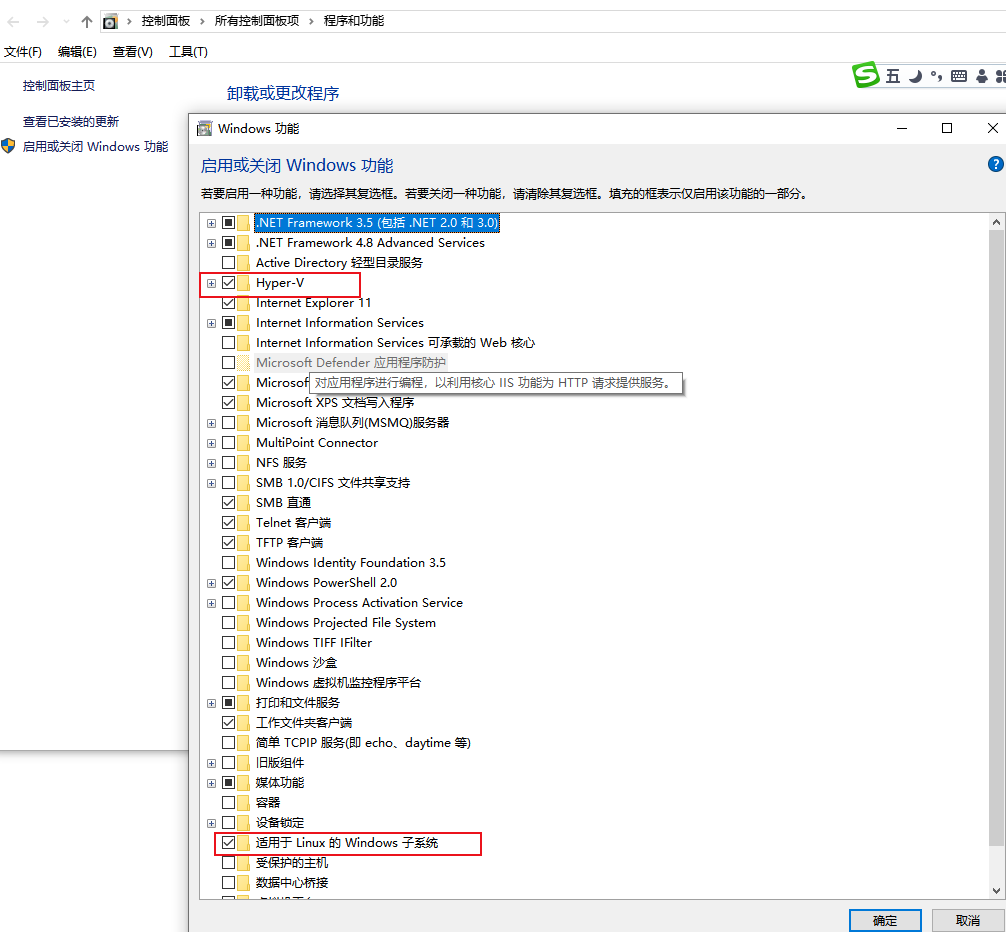

4.2 尝试界面操作打开配置功能

将系统这两项目功能打开。

使用 Docker Desktop 配合 WSL 2也可以参考以下文档:

- Docker Desktop 与 WSL 2 集成指南

WSL | Docker Docs

- 介绍了如何配置 Docker Desktop 使用 WSL 2 作为后端运行环境。

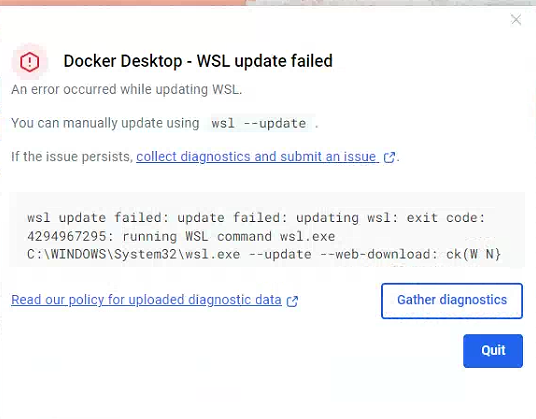

我的系统提示wsl启动报错,错误如下图所示

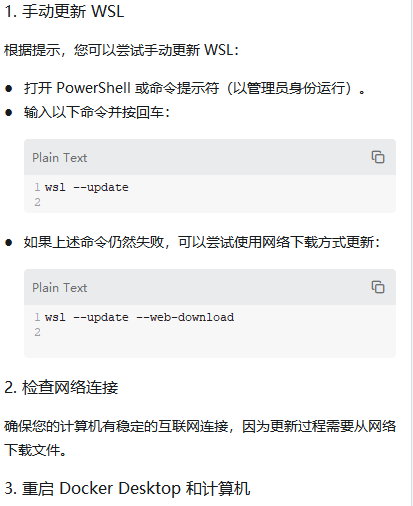

解决方案:更新wsl就可以了。

wsl --update

wsl --update --web-download

二、 ollama的安装与部署

ollama是一款本地化运行大预言模型(LLM)的开源工具。基于ollama可以在本地创建、运行和管理多种模型,同时可以方便的被其他应用调用。

下载地址:Ollama

下载后直接安装就可以了。

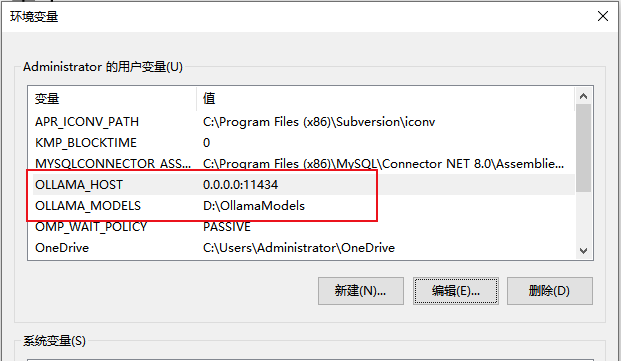

划重点:然后要在环境配置两个变量,一个是为了和RAGFlow进行通信,一个是因为模型库比较大,默认都放在C盘了。修改一下盘符

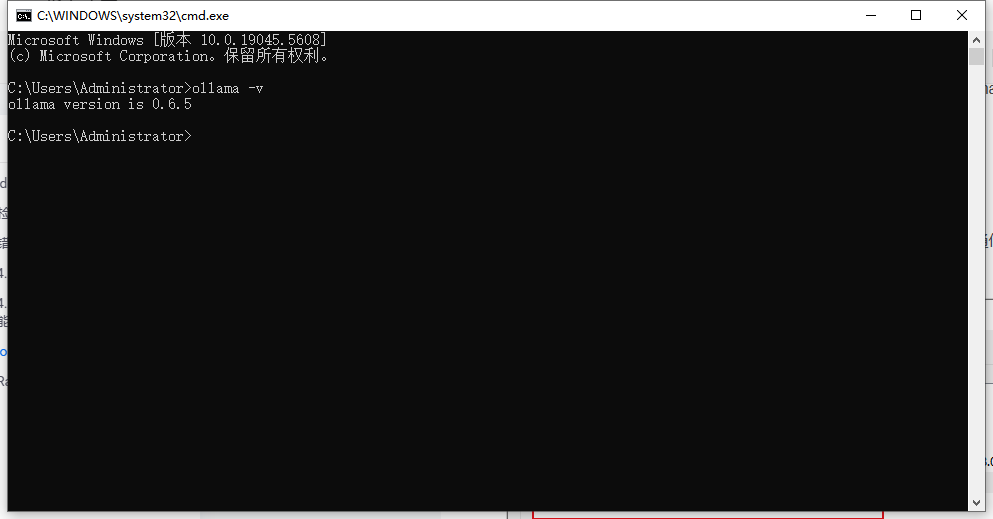

安装成功能后,在cmd窗口输入:ollama -v,显示如下表示安装成功。

下载embedding模型

下载地址:Embedding models · Ollama Search

5. docker 配置

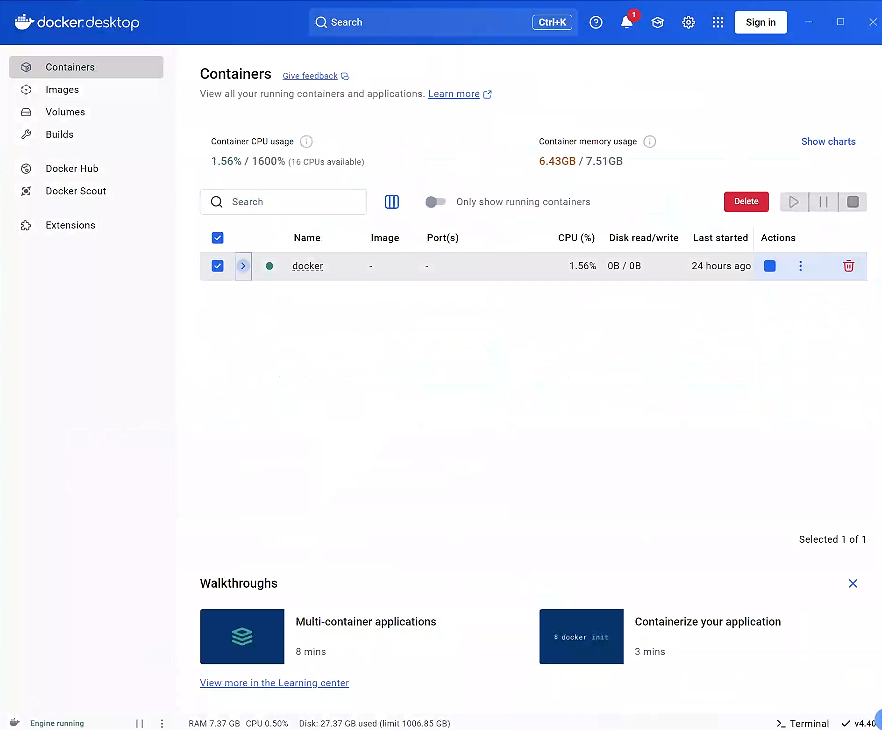

安装成功后进行docker界面,正常进入界面如下:

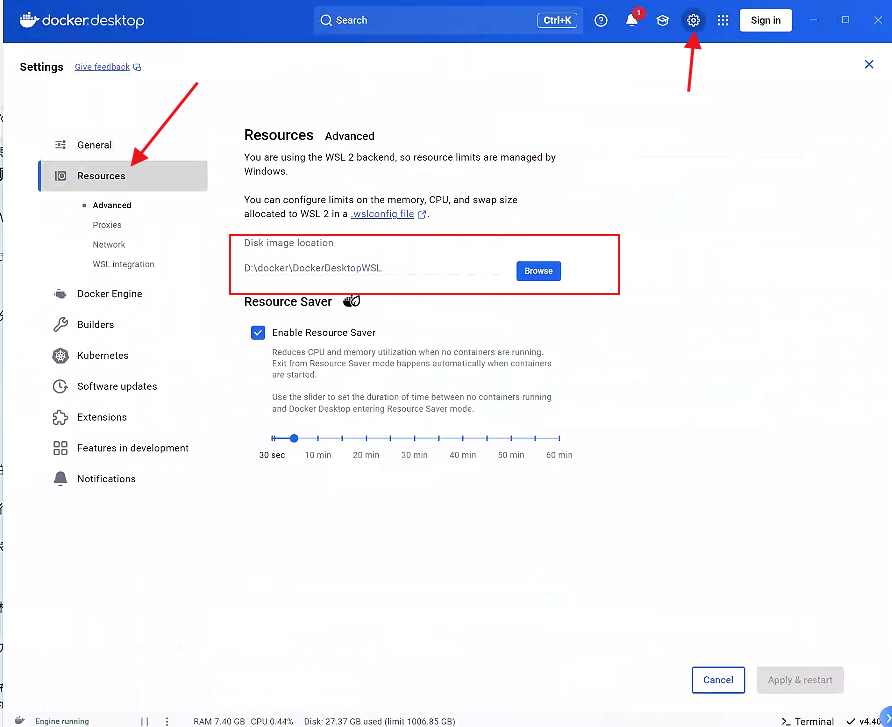

配置下载数据数源及镜像位置,避免因镜像文件过大,挤占C的空间

如图所示:

上图所示修改镜像位置为D盘

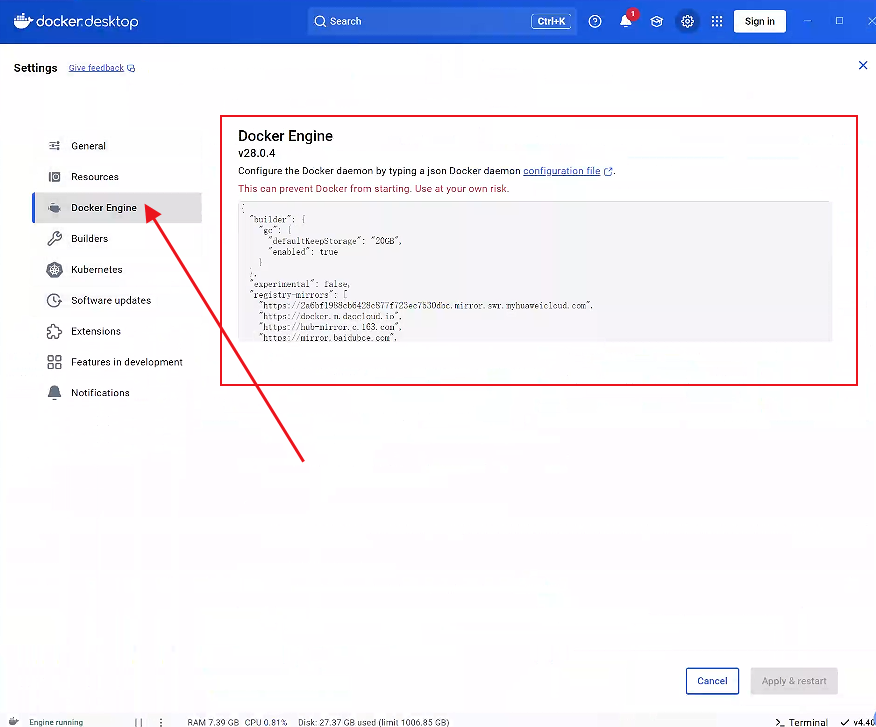

配置镜像下载数据源地址

在docker engine中填入

"builder": {"gc": {"defaultKeepStorage": "20GB","enabled": true}},"experimental": false,"registry-mirrors": ["https://2a6bf1988cb6428c877f723ec7530dbc.mirror.swr.myhuaweicloud.com","https://docker.m.daocloud.io","https://hub-mirror.c.163.com","https://mirror.baidubce.com","https://your_preferred_mirror","https://dockerhub.icu","https://docker.registry.cyou","https://docker-cf.registry.cyou","https://dockercf.jsdelivr.fyi","https://docker.jsdelivr.fyi","https://dockertest.jsdelivr.fyi","https://mirror.aliyuncs.com","https://dockerproxy.com","https://docker.m.daocloud.io","https://docker.nju.edu.cn","https://docker.mirrors.sjtug.sjtu.edu.cn","https://docker.mirrors.ustc.edu.cn","https://mirror.iscas.ac.cn","https://docker.rainbond.cc"]

}三、RagFlow的安装与部署

1、RagFlow介绍

RAGFlow 是一款基于深度文档理解的开源的 RAG(Retrieval-Augmented Generation)引擎,所谓 RAG 就是检索增强生成的简称。这款工具为企业和个人提供了精简的 RAG 工作流程。可以用于高效处理信息,为多种场景提供智能解决方案,如本地知识库的构建、问答系统的搭建,大量文本信息的处理等。

项目文档地址:https://github.com/infiniflow/ragflow/blob/main/README_zh.md

2、部署环境

基于ubuntu20.04进行部署。

RagFlow对电脑配置要求:

CPU ≥ 4 cores (x86);

RAM ≥ 16 GB;

Disk ≥ 50 GB;

Docker ≥ 24.0.0 & Docker Compose ≥ v2.26.1.

这个项目的源 Github 地址为:

RAGFlow

3. 安装部署RagFlow

1、首先将这个项目 Fork 到自己的账号中,然后点击右上角的 Code,点击 Download ZIP,下载到本地,解压到你想存放的本地文件夹。

2、进入刚才解压的文件夹,并进入其中的 docker 文件夹,打开cmd

3、首先修改一下.env 这个配置文件,目的是让其集成嵌入模型,默认安装的嵌入模型是轻量级模型,是没有嵌入模型的功能。

下图是原始的.env 配置文件中嵌入模型状态

修改时,只需要在第一个框轻量级前加上 #,把第二个框的模型前去掉 #即可,可见对比图

4、在执行 Docker compose 命令之前,需要先做一个修改,因为我的 Docker 中已经安装了 Dify,而 Dify 默认使用了 80 和 443 端口,如果直接安装,会出现端口冲突的问题。因此需要进行修改,把端口分别修改为 8080:80,8443:443。如果你电脑的80端口未被占用,就不需要修改。

5、现在就可以输入命令,有两组命令可根据电脑进行选择

第一组是使用 CPU 执行嵌入和 DeepDoc 任务(对于没有英伟达显卡的用户):

docker compose -f docker-compose.yml up -d

1

第二组是使用 GPU 加速嵌入和 DeepDoc 任务(对于有英伟达显卡的用户):

docker compose -f docker-compose-gpu.yml up -d

1

6、经过上面的步骤,现在 RAGFlow 就可以用 127.0.0.1:8080 打开了

7、登录RAGFlow后,先配置模型,填入相应的 API,系统会自动探测模型

其中的嵌入模型可以选 RAGFlow 内置的专门针对中文的 BGE 模型,也就是我们前面修改.env使其生效的模型。

接下来就可以创建知识库,搭建属于自己的 Agent 了。这是搭建的一个医用知识库及医用 Agent。

RAGFlow里的知识库不仅可以个人使用,也可以提供给团队使用,也是局域网使用知识库的解决方案之一。