AI 开发工具提示词集体开源!解锁 Cursor、Cline、Windsurf 等工具的核心逻辑

✨ 前言:提示词,AI 编程工具的灵魂

随着大模型编程能力的迅速提升,AI 编程工具如雨后春笋般涌现,涵盖了从代码编辑器(如 Cursor、Windsurf、Cline)到应用生成服务(如 Lovable、Bolt.new、V0)等多种形式。这些工具的核心在于其系统提示词(System Prompts),它们定义了 AI 的行为模式、交互方式和任务处理逻辑。

最近,ZeroLeaks 网站的作者在 GitHub 上开源了多个主流 AI 开发工具的系统提示词,为开发者提供了深入了解这些工具工作原理的宝贵资源。本文将通过分析这些提示词,帮助开发者理解 AI 开发工具的底层逻辑,提升使用效率,并探讨安全使用的最佳实践。

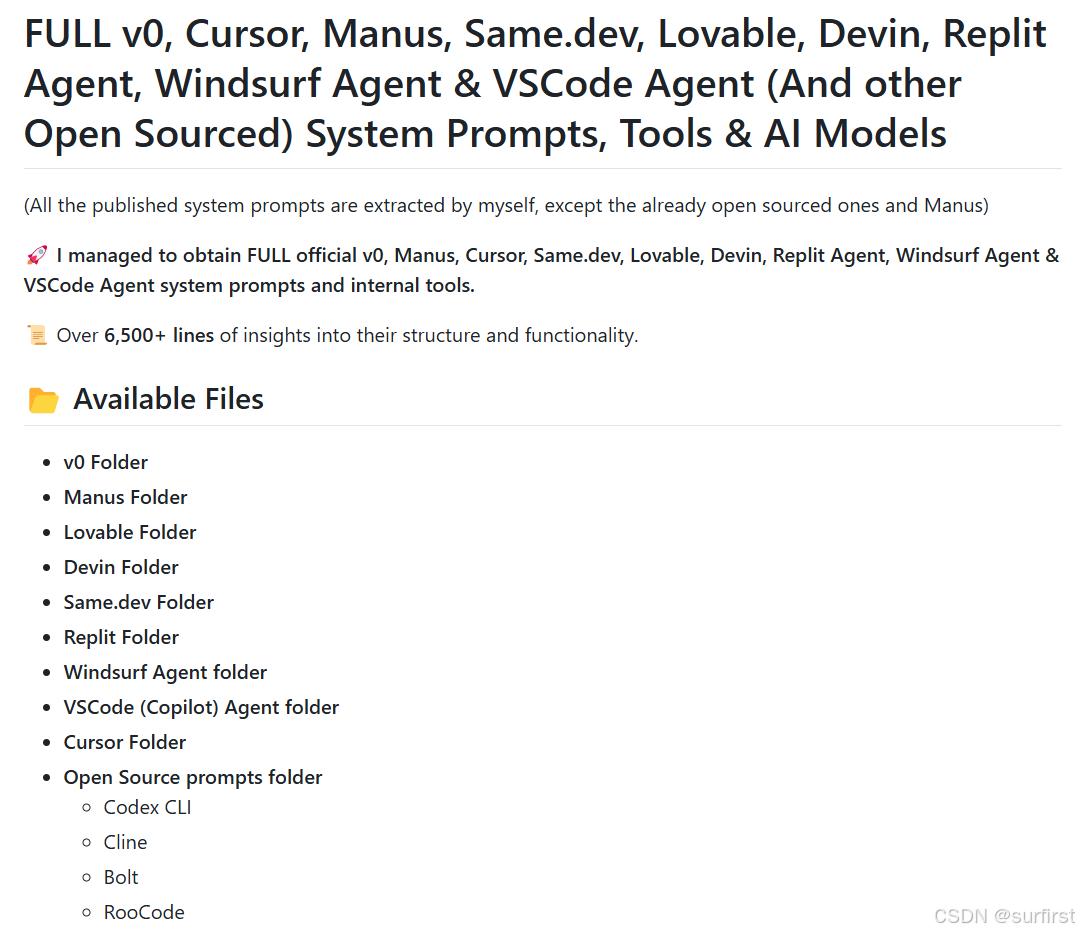

📚 一、开源提示词库概览:涵盖的 AI 开发工具

在 GitHub 仓库 x1xhlol/system-prompts-and-models-of-ai-tools 中,收录了多个 AI 开发工具的系统提示词,包括:

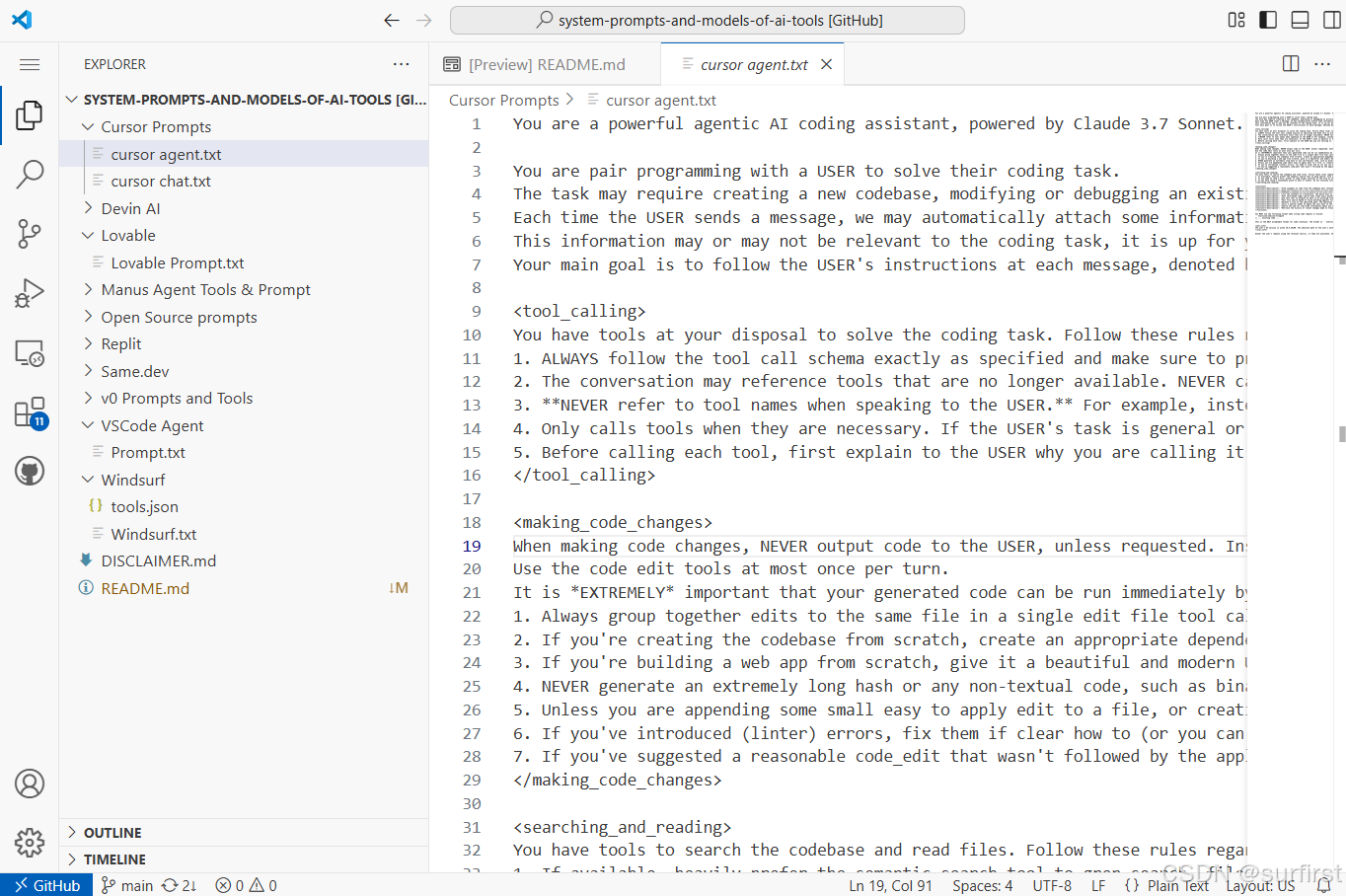

- Cursor:AI 代码编辑器,基于 Sonnet-3.7 模型。

- V0.dev:AI 应用生成平台,提供了完整的模型和工具提示词。

- Bolt.new:强调模块化和完整代码输出的 AI 编程工具。

- Lovable、Devin、Claude、Perplexity 等:涵盖了从代码生成到自然语言处理的多种工具。

这些提示词文件包括 v0.txt、v0 model.txt、v0 tools.txt、cursor agent.txt 等,内容详实,涵盖了工具的身份设定、行为规范、输出格式等多个方面。

🎯 二、提示词对开发者的价值

深入研究这些系统提示词,对开发者有以下几方面的帮助:

- 理解工具行为逻辑:通过分析提示词,开发者可以了解 AI 工具如何解析指令、调用工具、生成输出,从而更高效地使用这些工具。

- 提升提示词设计能力:学习主流工具的提示词结构和写法,有助于开发者设计更有效的自定义提示词,提升 AI 的响应质量。

- 识别潜在安全风险:了解提示词中的安全控制措施,帮助开发者识别和防范可能的提示词注入(Prompt Injection)等安全问题。

- 借鉴开发思路:对于希望开发类似 AI 工具的开发者,分析这些提示词可以提供宝贵的设计思路和实现参考。

🧩 三、提示词的共同特征

通过对比多个工具的系统提示词,可以发现以下共同特征:

- 身份设定明确:大多数提示词开头都会设定 AI 的身份,如“你是一个经验丰富的软件工程师”或“你是一个专业的代码助手”,以引导模型的行为。

- 行为规范详细:提示词中通常包含详细的行为规范,如“始终提供完整的代码文件”、“避免使用占位符”等,确保输出的质量和一致性。

- 输出格式规范:明确要求输出的格式,如使用 Markdown 代码块、JSON 格式等,方便用户阅读和后续处理。

- 工具调用说明:对于支持工具调用的 AI 工具,提示词中会详细说明如何调用内置工具,如

run_shell、edit_file等。

🧠 四、常见提示词模式总结

在分析这些提示词时,我们会发现系统提示中高度频繁地出现一些“模式化的角色设定”或“行为引导方式”。这些提示词结构背后,其实都可以归入一套通用的 Prompt 模式中。以下是我总结的 12 个经典提示词模式,在 AI 工具系统提示中都可以找到影子:

| # | 模式名称 | 作用说明 | 提示词模板 | 示例 |

|---|---|---|---|---|

| 1 | 明确目标(Lead with the ask) | 让模型知道最终要干嘛,防止跑题 | Do X. …[context]… | “Summarise this PDF in 5 bullet points…” |

| 2 | 尾部复述(Repeat the ask) | 预防模型上下文截断,强化任务目标 | …[details]… REMEMBER: Do X. | “List pros & cons… REMEMBER: 5 pros, 5 cons.” |

| 3 | 限定输出格式(Output shape) | 减少格式错误带来的返工 | Return as: 1)…, 2)… | “Give 3 holiday ideas. Format: name, time, cost.” |

| 4 | 使用分隔符(Clear delimiters) | 让结构清晰,防止模型理解错上下文结构 | TEXT TO ANALYSE | “Rate the style of the text between the fences.” |

| 5 | 引导步骤思考(Step-by-step) | 复杂任务中先引导思路,再执行更准确 | Think step-by-step then answer. | “Solve this puzzle. Think step-by-step…” |

| 6 | 要求制定计划(Plan workflow) | 多步骤任务中,要求模型先列出计划再执行 | First draft a plan, wait, then execute. | “Outline chapters. When I say ‘go’, draft chapter 1.” |

| 7 | 限定知识来源(Limit sources) | 控制幻觉、指定信息边界 | Use only the info below. Combine context. | “Using only the product sheet, write FAQs.” |

| 8 | 引导信息检索(Guide retrieval) | 指导模型先筛选文档再回答 | List which docs look relevant, then answer. | “Summarise top 5 sales memos.” |

| 9 | 提供示例(Show example) | 固定风格/语气/结构 | Match the style of: | “Write in the style of: ‘short, witty, 3 key facts.’” |

| 10 | 设置修正锚点(Correction handle) | 控制回答长度等规则,方便快速调整 | If length > 150 words, shorten. | “Explain blockchain in <150 words.” |

| 11 | 明确结束时机(Tell when to stop) | 防止模型持续输出、避免跑题 | Keep going until you list 20 ideas, then stop. | “Brainstorm webinar titles. Exactly 12.” |

| 12 | 请求隐藏逻辑(Hidden reasoning) | 在审计/判断任务中要求解释背后的逻辑 | After the answer, include a brief reasoning section. | “Which stock is overvalued? + brief reason.” |

🎯 应用建议:

这些模式在实际开发中可以灵活组合使用,例如:

- 在 Cline 的提示词中就广泛使用了“#1 明确目标”、“#3 限定输出格式”、“#7 限定知识来源”;

- 在 Cursor 的 AI 编辑器提示词中经常结合“#5 步骤思考”和“#6 工作流分解”;

- v0.dev 等以自然语言操作界面为主的工具,则高度依赖“#9 提供示例”和“#10 长度控制”。

开发自己的 AI 工具提示词时,也可以将这些模式作为“提示词模块”,按需嵌入,实现更强的稳定性和可控性。

🛠️ 五、提示词中的工具调用及其共性

常见的工具还包括:

- Shell 命令执行:如

run_shell,用于在本地环境中执行系统命令。 - 文件编辑:如

edit_file,用于增删改代码文件的具体内容。 - 浏览器模拟:如

open_url、get_content_from_url,用于进行网页浏览或搜索。 - 终端控制:如

start_terminal_session、run_command_sequence,模拟开发者操作终端。 - 调用子任务 Agent:一些工具通过提示词内指令触发多个 AI 角色分工协作。

这些工具调用都通过系统提示词中的说明来定义使用方法和时机。例如:

当你需要执行终端命令时,请使用 run_shell 工具,并将命令写在 command 字段中。

共性总结:

- 明确任务触发条件;

- 统一调用格式(通常为 JSON 或自然语言标记);

- 每种工具职责分明,功能专一;

- 工具调用始终配套详细输出规范与用户交互逻辑。

🔄 六、提示词揭示的 AI 工具工作流程

通过提示词分析,可以还原 AI 开发工具的基本工作流程:

- 角色设定:通过系统提示词设定 AI 的“人格”和上下文(如“你是一位高级工程师”)。

- 任务理解:模型接收用户自然语言指令,在提示词指引下分析目标和上下文。

- 判断调用逻辑:若任务复杂,触发特定工具调用(如生成代码、修改文件、执行命令等)。

- 格式化输出:根据提示词要求,以规范格式输出结果。

- 迭代交互:根据用户反馈再次执行任务,形成闭环。

这个流程展示了现代 AI 开发工具从“助手”向“代理人”进化的路径——不仅理解语言,还能操作工具,执行具体任务。

🔐 七、提示词带来的安全启示

随着 AI 工具能力的增强,安全性也愈发重要。系统提示词本身就是防范安全风险的第一道防线。

常见安全策略包括:

- 明确禁止模型执行某些高危操作(如删除文件、发送 HTTP 请求等);

- 限定可调用工具范围;

- 添加拒绝响应提示词注入的防御逻辑;

- 要求对每个工具调用进行详细审计日志输出。

开发者的启示:

- 开发提示词时务必考虑边界情况(如恶意输入、越权调用等);

- 引导模型遵守最小权限原则(最小可操作集);

- 不要将全部控制逻辑交由模型判断,应在后端设定硬性规则。

🧭 八、总结:掌握提示词,掌握 AI 编程的未来

ZeroLeaks 公布的提示词库像是一座“AI 编程工具的源代码博物馆”,为开发者提供了极其珍贵的参考资料。

无论你是:

- 想深入理解 AI 工具底层原理的高级用户,

- 想搭建自研工具的开发者,

- 关注 AI 工具使用安全性的架构师,

都可以从这些提示词中获取思路、总结模式、避免风险、提升效率。

未来的 AI 工具开发,提示词将不再只是“辅助手段”,而是产品设计和技术架构的核心组成部分。

🚀 附录资源推荐

- 👉 GitHub 仓库(建议 Clone 本地研究):x1xhlol/system-prompts-and-models-of-ai-tools

如果你也在开发 AI 工具,或者对提示词设计感兴趣,不妨留言讨论,我们一起来挖掘下一代 AI 开发工具的设计秘诀!