时序预测 | Transformer-LSTM-SVM时间序列预测(Matlab完整源码和数据,适合基础小白研究)

时序预测 | Transformer-LSTM-SVM时间序列预测(Matlab完整源码和数据,适合基础小白研究)

目录

- 时序预测 | Transformer-LSTM-SVM时间序列预测(Matlab完整源码和数据,适合基础小白研究)

- 效果一览

- 基本介绍

- 代码功能

- 程序设计

- 参考资料

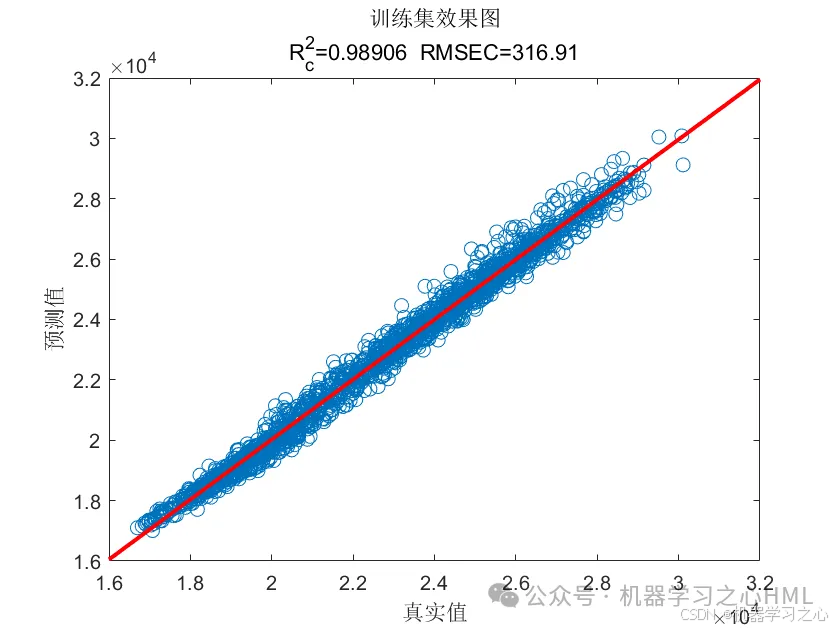

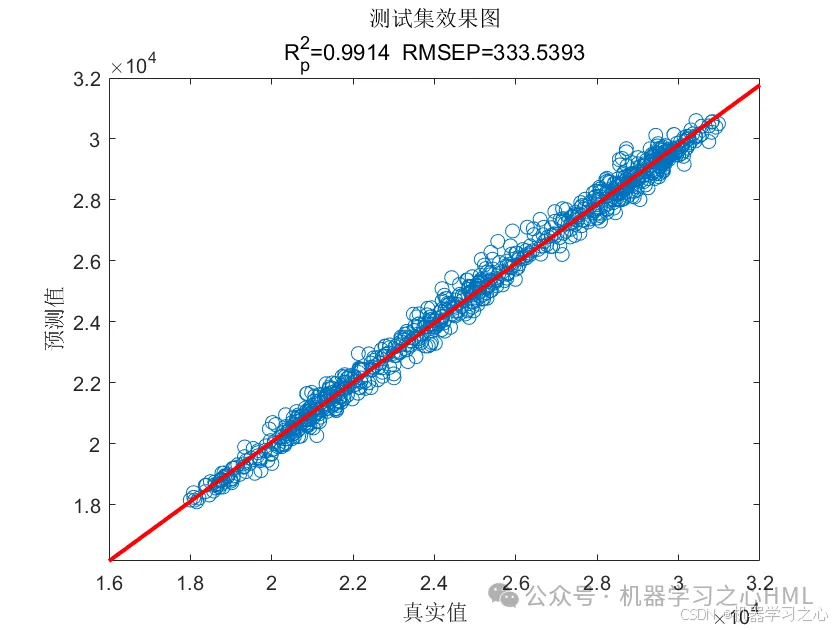

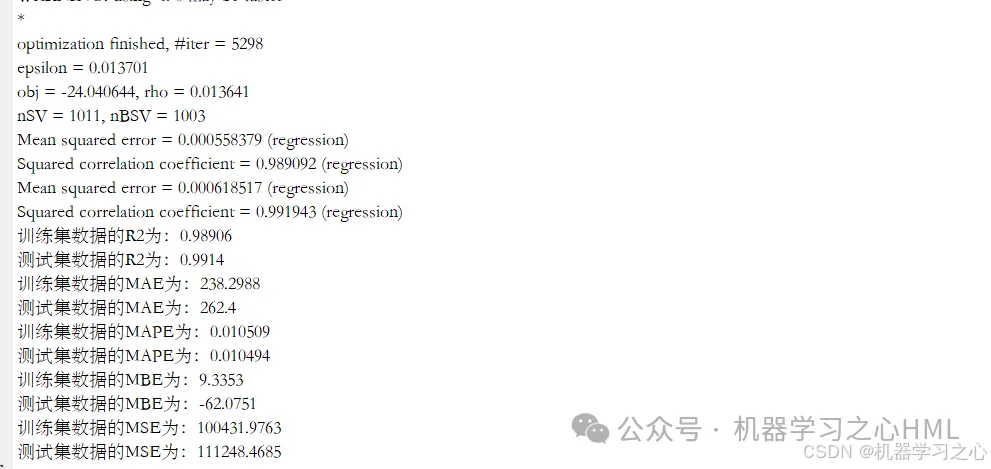

效果一览

基本介绍

1.Matlab实现Transformer-LSTM-SVM时间序列预测,Transformer-长短期记忆神经网络-支持向量机时间序列预测;

2.运行环境为Matlab2023b及以上;

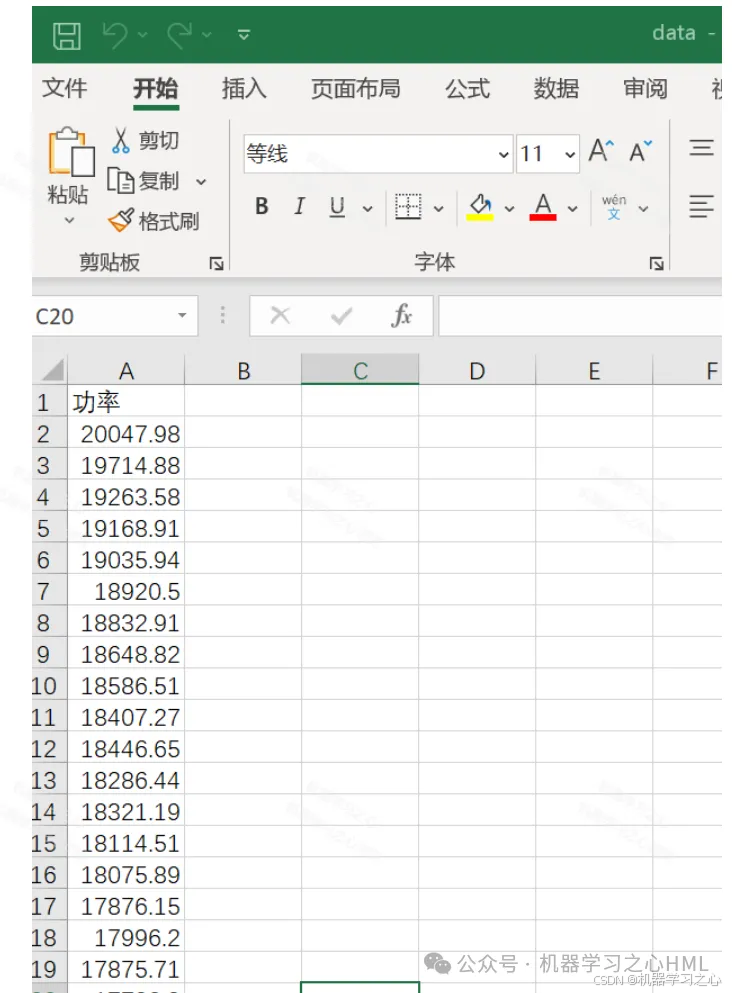

3.data为数据集,输入输出单个变量,单变量时间序列预测,main.m为主程序,运行即可,所有文件放在一个文件夹;

4.命令窗口输出R2、MSE、RMSE、MAE、MAPE、MBE等多指标评价;

代码功能

代码实现了一个结合Transformer-LSTM-SVM的混合模型,用于时间序列预测。主要功能如下:

- 数据预处理

数据导入与结构划分

从data.xlsx中读取单列时间序列数据,通过滑动窗口方法生成输入-输出样本。每个输入样本包含kim个历史数据点,输出下一步目标值。

数据集划分

将数据按比例(默认70%)划分为训练集和测试集,并进行归一化处理,以提升模型训练的稳定性。

格式转换

将数据转换为适合神经网络输入的序列格式(单元数组)。

- 模型构建

Transformer-LSTM模型

输入层接收特征维度为f_的序列数据。

位置嵌入层(positionEmbeddingLayer)为序列添加位置编码。

自注意力层(selfAttentionLayer)捕捉序列中的全局依赖关系。

LSTM层提取时序特征,并通过ReLU激活函数和Dropout层防止过拟合。

全连接层输出最终预测结果,使用回归层完成端到端训练。

训练配置

采用Adam优化器,设置学习率、批处理大小和最大训练轮次。

- 特征提取与SVM优化

特征提取

从训练好的Transformer-LSTM模型中提取全连接层(fc)的特征,作为SVM的输入。

SVM回归

使用LibSVM进行训练和预测。

- 性能评估与可视化

指标计算

计算训练集和测试集的R²、MAE、MAPE、MBE、MSE和RMSE,全面评估模型性能。

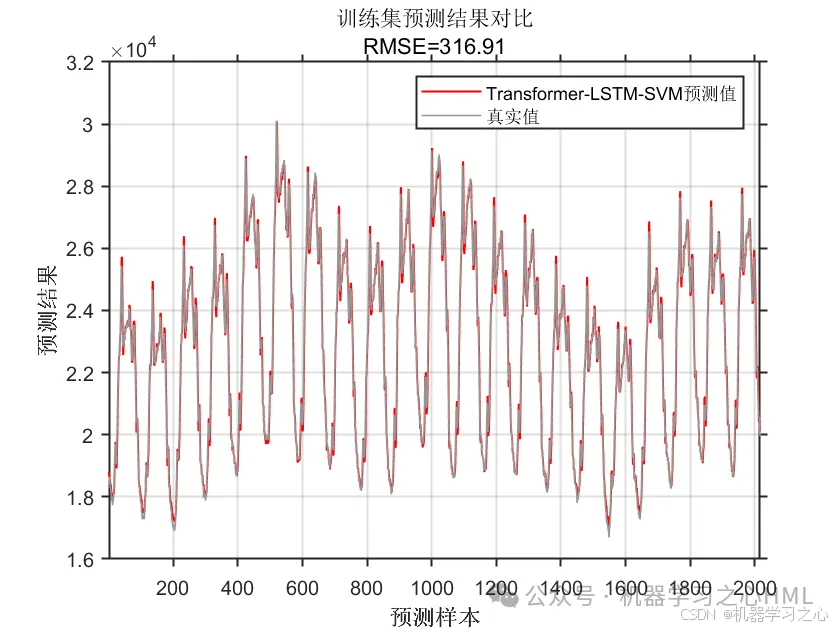

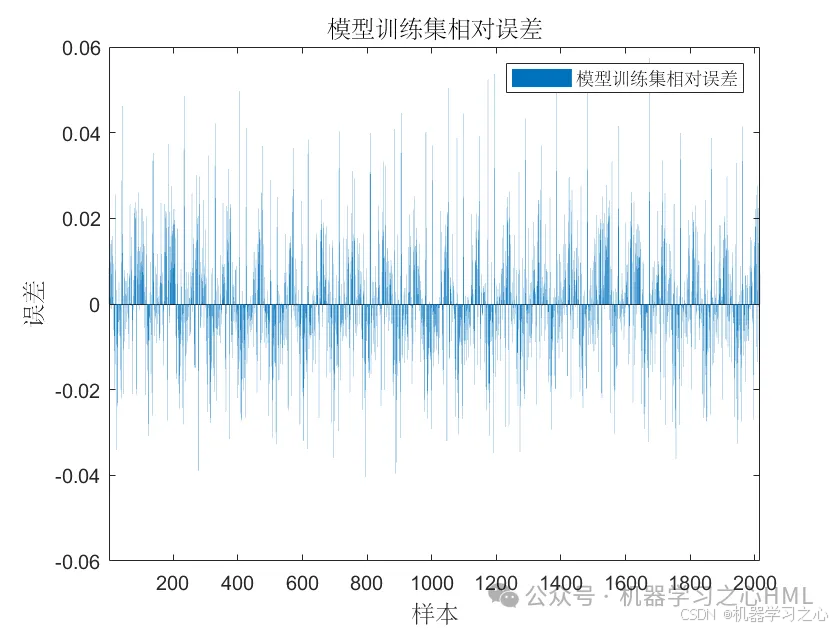

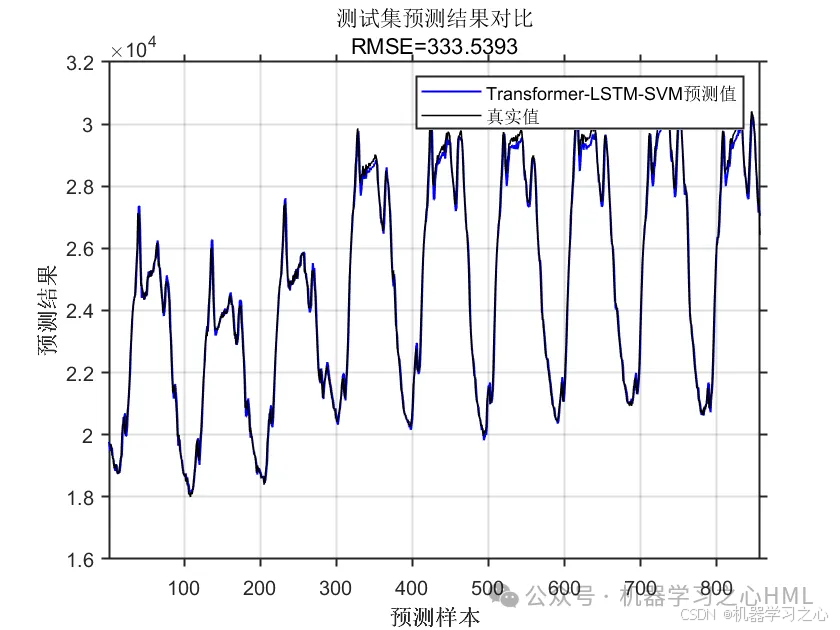

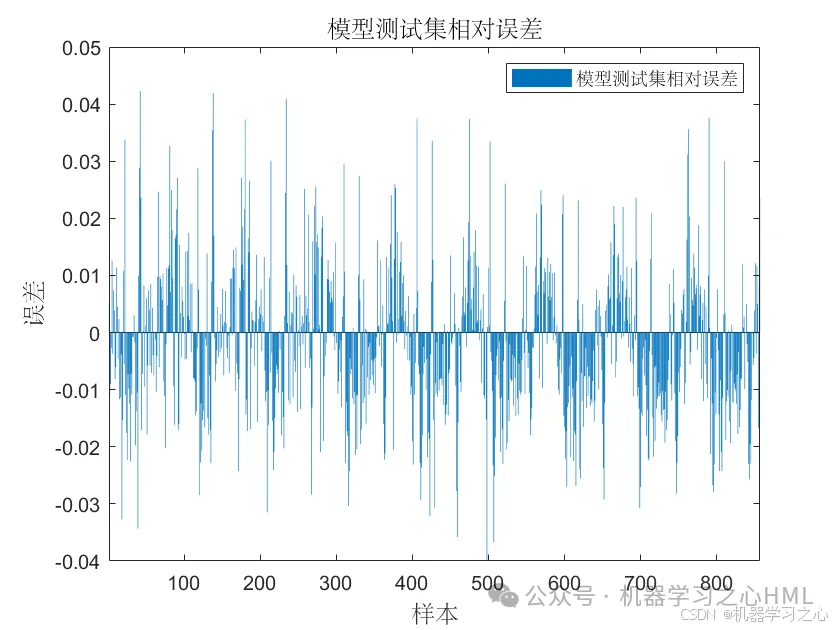

可视化分析

绘制预测值与真实值的对比曲线,展示训练集和测试集的拟合效果。

生成相对误差条形图,直观显示模型在各样本点的误差分布。

通过线性拟合图(lsline)验证预测值与真实值的相关性。

- 关键特点

混合架构优势

结合Transformer的全局注意力机制和LSTM的时序建模能力,增强模型对复杂时间序列模式的捕捉。

端到端流程

涵盖数据预处理、模型训练、特征融合、后处理优化及可视化分析,形成完整的时间序列预测流程。

兼容性要求

依赖MATLAB 2023b及以上版本,使用了新版内置函数(如自注意力层、位置嵌入层)。

程序设计

- 完整程序和数据获取方式私信博主回复TTransformer-LSTM-SVM时间序列预测(Matlab完整源码和数据,适合基础小白研究)。

%% 导入数据(时间序列的单列数据)

result = xlsread('data.xlsx');

%% 数据分析

num_samples = length(result); % 样本个数

kim = 7; % 延时步长(kim个历史数据作为自变量)

zim = 1; % 跨zim个时间点进行预测%% 数据集分析

outdim = 1; % 最后一列为输出

num_size = 0.7; % 训练集占数据集比例%% 划分训练集和测试集

P_train = res(1: num_train_s, 1: f_)';

T_train = res(1: num_train_s, f_ + 1: end)';

M = size(P_train, 2);

P_test = res(num_train_s + 1: end, 1: f_)';

T_test = res(num_train_s + 1: end, f_ + 1: end)';

N = size(P_test, 2);

% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

% 格式转换

for i = 1 : M vp_train{i, 1} = p_train(:, i);

endnumChannels = f_;

maxPosition = 256;

numHeads = 4;

numKeyChannels = numHeads*32;

layers = [ sequenceInputLayer(numChannels,Name="input")positionEmbeddingLayer(numChannels,maxPosition,Name="pos-emb");additionLayer(2, Name="add")selfAttentionLayer(numHeads,numKeyChannels,'AttentionMask','causal')selfAttentionLayer(numHeads,numKeyChannels)参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/127931217

[2] https://blog.csdn.net/kjm13182345320/article/details/127418340