计算机视觉与深度学习 | LSTM原理及与卡尔曼滤波的融合

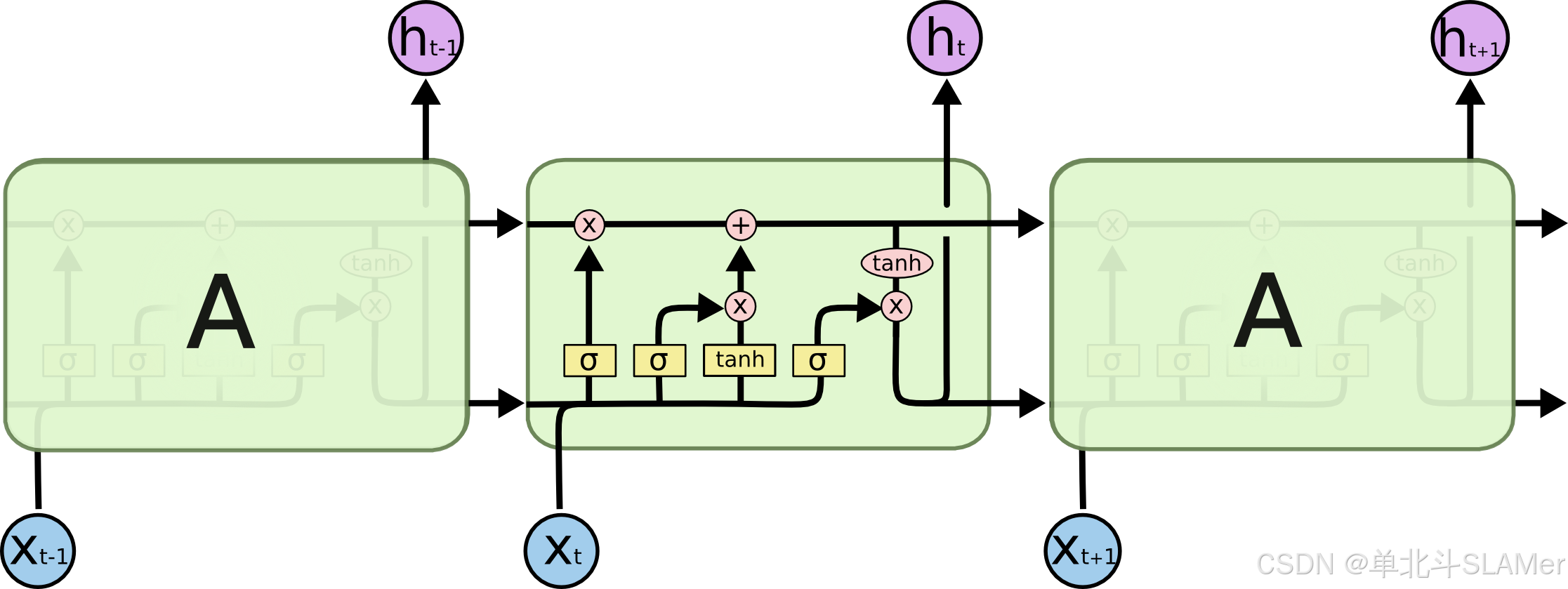

- 长短期记忆网络(LSTM)是一种特殊的循环神经网络(RNN),旨在解决传统RNN在处理长序列数据时出现的梯度消失和梯度爆炸问题。以下为你详细介绍其基本原理:

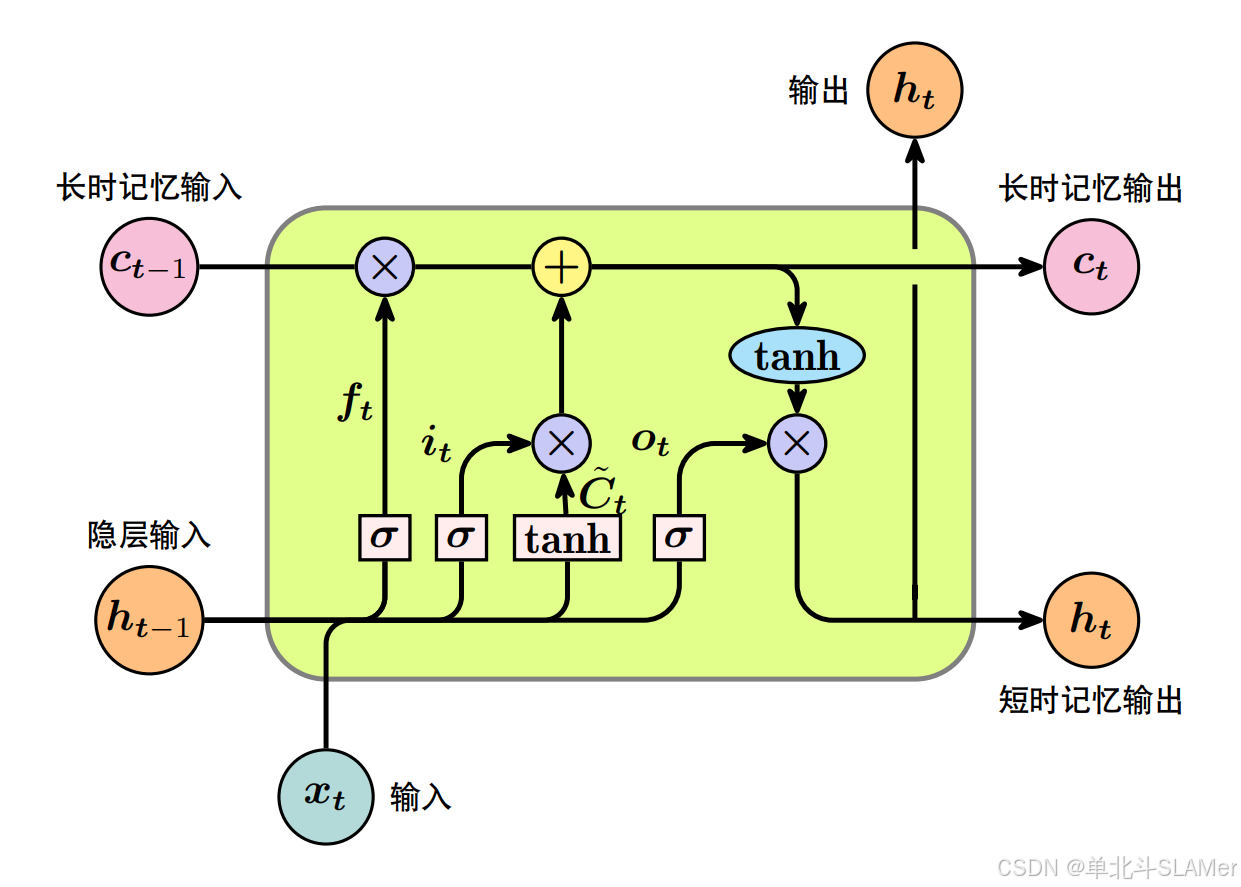

- 核心思想:LSTM的核心思想是引入记忆单元和门控机制来控制信息的流动,从而解决传统RNN的梯度消失问题。记忆单元类似于一个容器,可以存储长期依赖信息,其初始状态为零向量,在每个时间步长都会根据输入信息和隐藏状态进行更新。

- 结构组成:LSTM由输入层、隐藏层和输出层组成,其中隐藏层包含多个LSTM单元。每个LSTM单元包含遗忘门、输入门、输出门和细胞状态。

门控机制:

- 遗忘门:决定哪些信息需要从记忆单元中遗忘。它通过一个sigmoid层实现,输出一个0到1之间的数值,表示信息保留或遗忘的程度,1表示“完全保留”,0表示“完全遗忘”。选择性遗忘机制可以避免长期依赖关系被无用信息淹没。

- 输入门&#x